Architektura ciszy. Odporność poznawcza jako nowa doktryna obronna

Od dezinformacji do immunizacji. Dlaczego tradycyjna weryfikacja faktów przestała wystarczać w świecie zdominowanym przez AI.

Analiza prezentuje ewolucję walki z dezinformacją w stronę „suwerenności poznawczej”, opartej na psychologicznej higienie jednostki oraz systemowych standardach transparentności algorytmicznej i technologicznej.

Założenia analityczne

Niniejsza analiza opiera się na scenariuszu roku 2026, w którym dominacja treści syntetycznych generowanych przez AI uniemożliwia stosowanie tradycyjnych metod weryfikacji faktów, co wymusza uznanie procesów poznawczych obywateli za element infrastruktury krytycznej państwa. Strategia „Tarcza Poznawcza” zakłada, że w obliczu zerowych kosztów produkcji dezinformacji, jedyną skuteczną formą obrony jest przejście od reaktywnej cenzury ku proaktywnemu budowaniu psychologicznej i technologicznej odporności społeczeństwa. Powodzenie tego modelu zależy od rygorystycznej transparentności algorytmicznej oraz apolitycznego wdrożenia narzędzi certyfikacji źródeł, co jest niezbędne dla zachowania zaufania publicznego i suwerenności informacyjnej w demokratycznym państwie.

Sygnał

Przejście od zwalczania “fake newsów” do systemowej ochrony procesów myślowych i emocjonalnych obywatela jako infrastruktury krytycznej państwa.

Kontekst

W roku 2026 treści generowane przez sztuczną inteligencję stanowią większość ruchu sieciowego, co uniemożliwia skuteczne działanie tradycyjnych metod weryfikacji. Państwa stają przed dylematem walki z masową dezinformacją bez wprowadzania cenzury, która niszczy zaufanie społeczne do instytucji publicznych. W odpowiedzi powstają koncepcje suwerenności poznawczej, traktujące umysły obywateli jako element doktryny obronnej kraju.

Analiza

Neurobiologia manipulacji a higiena cyfrowa

Dezinformacja celuje bezpośrednio w ośrodki emocjonalne, takie jak ciało migdałowate, omijając racjonalną analizę. Odporność na tym poziomie wymaga nie „wiedzy”, lecz zdolności do rozpoznania własnego piku emocjonalnego.

Emocje takie jak strach czy gniew działają jak „wyłączniki” kory przedczołowej odpowiedzialnej za logikę.

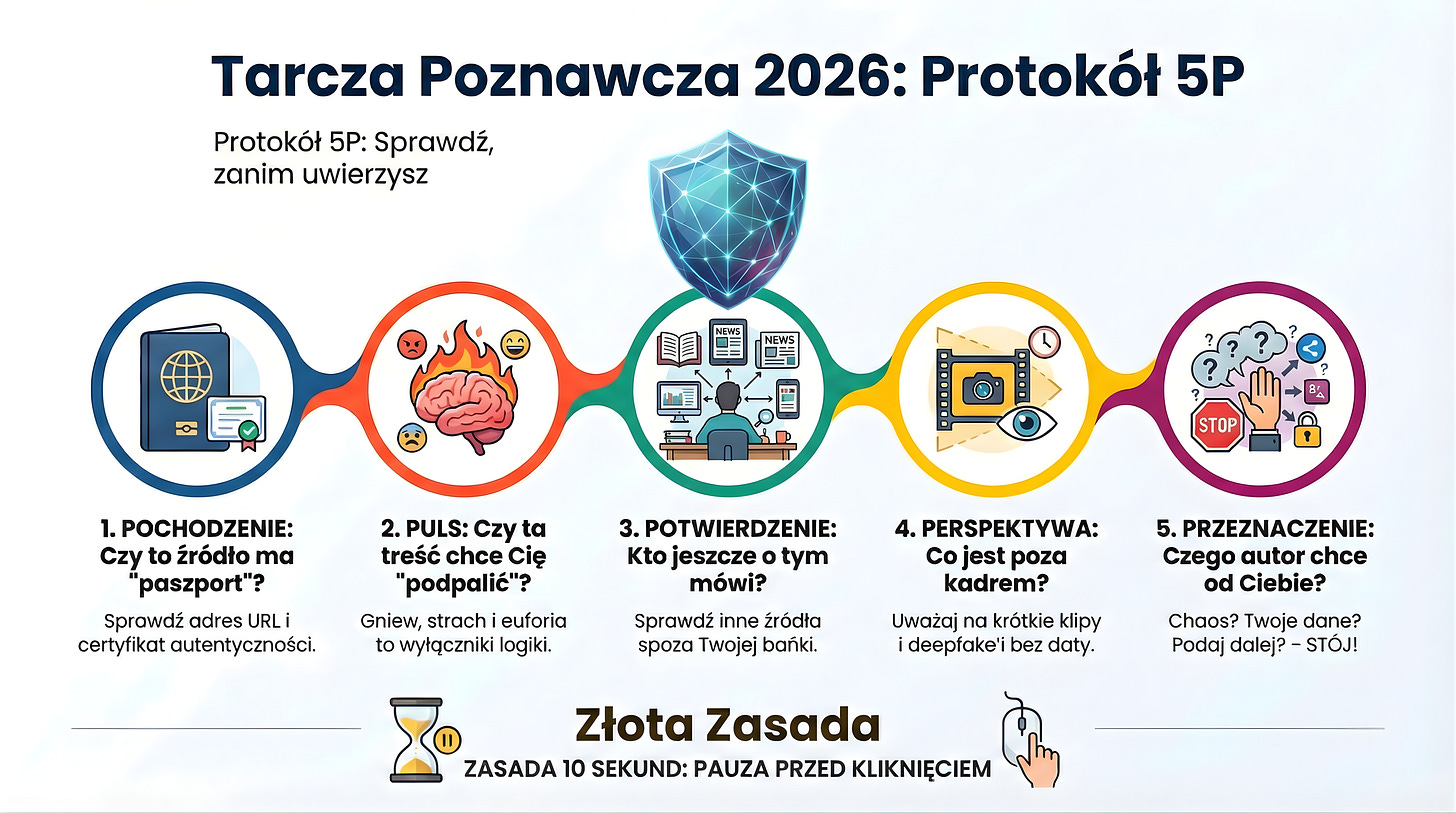

Skuteczna obrona polega na wstrzymaniu reakcji do momentu ochłonięcia, co nazywane jest „zasadą 10 sekund pauzy”.

Bez stabilności emocjonalnej nawet najlepiej wykształcona osoba pozostaje podatna na manipulację.Efekt śpiącego i trwałość fałszywych narracji

Informacje pozostają w pamięci długo po tym, jak zapomnimy o ich niewiarygodnym źródle, co nadaje im status „prawdopodobnych”. Zjawisko to sprawia, że samo zaprzeczanie kłamstwom jest nieskuteczne.

Ludzki mózg oddziela treść komunikatu od jego kontekstu (źródła) w miarę upływu czasu.

Odporność wymaga aktywnego nadpisywania błędnych danych, a nie tylko ich odrzucania.

Raz zasiane ziarno niepewności pracuje w psychice niezależnie od późniejszych sprostowań.Paradoks Dunninga-Krugera w informacyjnej obronie

Osoby najbardziej pewne swojej odporności na manipulację są statystycznie najbardziej na nią podatne. Prawdziwa bariera ochronna budowana jest na fundamencie intelektualnej pokory.

Nadmierna pewność siebie osłabia czujność i zniechęca do korzystania z narzędzi weryfikacyjnych.

Pokora pozwala na krytyczną autoanalizę własnych uprzedzeń poznawczych.

Przekonanie o własnej nieomylności jest najkrótszą drogą do stania się ofiarą operacji psychologicznej.Erozja wspólnego gruntu faktograficznego

Zagrożeniem dla społeczeństwa nie jest wiara w konkretne kłamstwa, ale całkowita utrata wiary w istnienie obiektywnej prawdy. Społeczeństwo odporne to takie, które zgadza się co do faktów podstawowych, mimo różnic w ich interpretacji.

Brak wspólnego gruntu uniemożliwia jakąkolwiek debatę publiczną i prowadzi do paraliżu państwa.

Spójność społeczna jest ważniejsza dla przetrwania niż techniczna poprawność każdego pojedynczego newsa.

Celem ataków informacyjnych jest wywołanie chaosu, w którym obywatel przestaje wierzyć w cokolwiek.Kapitał społeczny jako naturalny filtr

Silne, bezpośrednie relacje międzyludzkie (offline) stanowią barierę dla cyfrowych botów i trolli. Relacje osobiste działają jak naturalny system weryfikacji, trudniejszy do zmanipulowania niż interakcje cyfrowe.

Znajomość osobista nadawcy utrudnia skuteczne działanie anonimowych operacji wpływowych.

Lokalne wspólnoty posiadają własne mechanizmy weryfikacji oparte na wieloletnim zaufaniu.

Osłabienie więzi sąsiedzkich i rodzinnych bezpośrednio obniża odporność informacyjną całego kraju.Algorytmiczny trybalizm i budowanie mostów

Współczesne platformy cyfrowe promują polaryzację i nienawiść do „obcego” jako paliwo dla zasięgów. Budowanie mostów ponad bańkami informacyjnymi staje się w tym kontekście aktem oporu.

Algorytmy nagradzają treści skrajne, które szybciej stają się wiralami.

Odporność społeczna polega na umiejętności komunikacji z grupami o odmiennych poglądach.

Izolacja w bańkach informacyjnych jest naturalnym środowiskiem dla operacji dezinformacyjnych.Umysł obywatela jako infrastruktura krytyczna

Państwo w 2026 roku musi traktować procesy poznawcze swoich obywateli jako zasób wymagający ochrony na równi z siecią energetyczną. Wojna poznawcza dąży do paraliżu decyzyjnego całych instytucji.

Ataki informacyjne mogą zablokować działanie państwa poprzez wywołanie masowej paniki lub buntu.

Stabilność państwa zależy od zaufania obywateli do oficjalnych kanałów komunikacji.

Suwerenność poznawcza to zdolność społeczeństwa do odróżnienia informacji od wrogiej operacji psychologicznej.Paradoks regulacyjny. Odporność vs Cenzura

Zbyt silna kontrola informacji przez państwo paradoksalnie osłabia odporność, bo niszczy zaufanie do instytucji publicznych. Obywatel pozbawiony wolności słowa staje się łatwym łupem dla narracji alternatywnych.

Cenzura działa reaktywnie i często wywołuje efekt Streisand, zwiększając zasięgi zakazanych treści.

Zaufanie buduje się przez transparentność, a nie przez siłowe usuwanie niewygodnych narracji.

Model odporny stawia na proaktywne budowanie kompetencji zamiast usuwania treści.Asymetria kosztów w erze AI

Wyprodukowanie dezinformacji przez AI jest niemal darmowe, podczas gdy jej weryfikacja przez ekspertów jest droga i powolna. To wymusza automatyzację systemów ostrzegania i edukację masową.

Państwo nie wygra walki z AI za pomocą manualnego fact-checkingu.

Rozwiązaniem jest budowanie systemów „wczesnego ostrzegania” rozpoznających techniki, a nie konkretne newsy.

Systemowa odporność musi być tańsza i szybsza niż generowanie fałszu.Strategia pre-bunkingu jako „szczepionka”

Zamiast prostować kłamstwo, które już zainfekowało opinię publiczną, należy uczyć obywateli mechanizmów manipulacji. Wiedza o tym, „jak” jesteśmy oszukiwani, chroni lepiej niż informacja o tym, „co” jest nieprawdą.

Użytkownik świadomy technik (np. działania deepfakes) staje się na nie trwale uodporniony.

Kampanie społeczne powinny uprzedzać o nadchodzących narracjach kryzysowych.

Inokulacja informatyczna pozwala obywatelowi zachować autonomię decyzyjną.Radykalna transparentność algorytmiczna i standardy pochodzenia

Wymuszenie na platformach ujawniania, dlaczego dany post staje się wiralem, uderza w źródło problemu. Wprowadzenie standardów takich jak C2PA (cyfrowy paszport pliku) pozwala na natychmiastową weryfikację autentyczności.

Ograniczenie „zasięgów” (reach) jest skuteczniejsze niż walka z „mową” (speech).

Metadane o pochodzeniu treści pozwalają odróżnić oficjalny komunikat od deepfake’a.

Państwo powinno promować standardy open-source, aby nie być jedynym arbitrem prawdy.Program „Tarcza Poznawcza” w praktyce

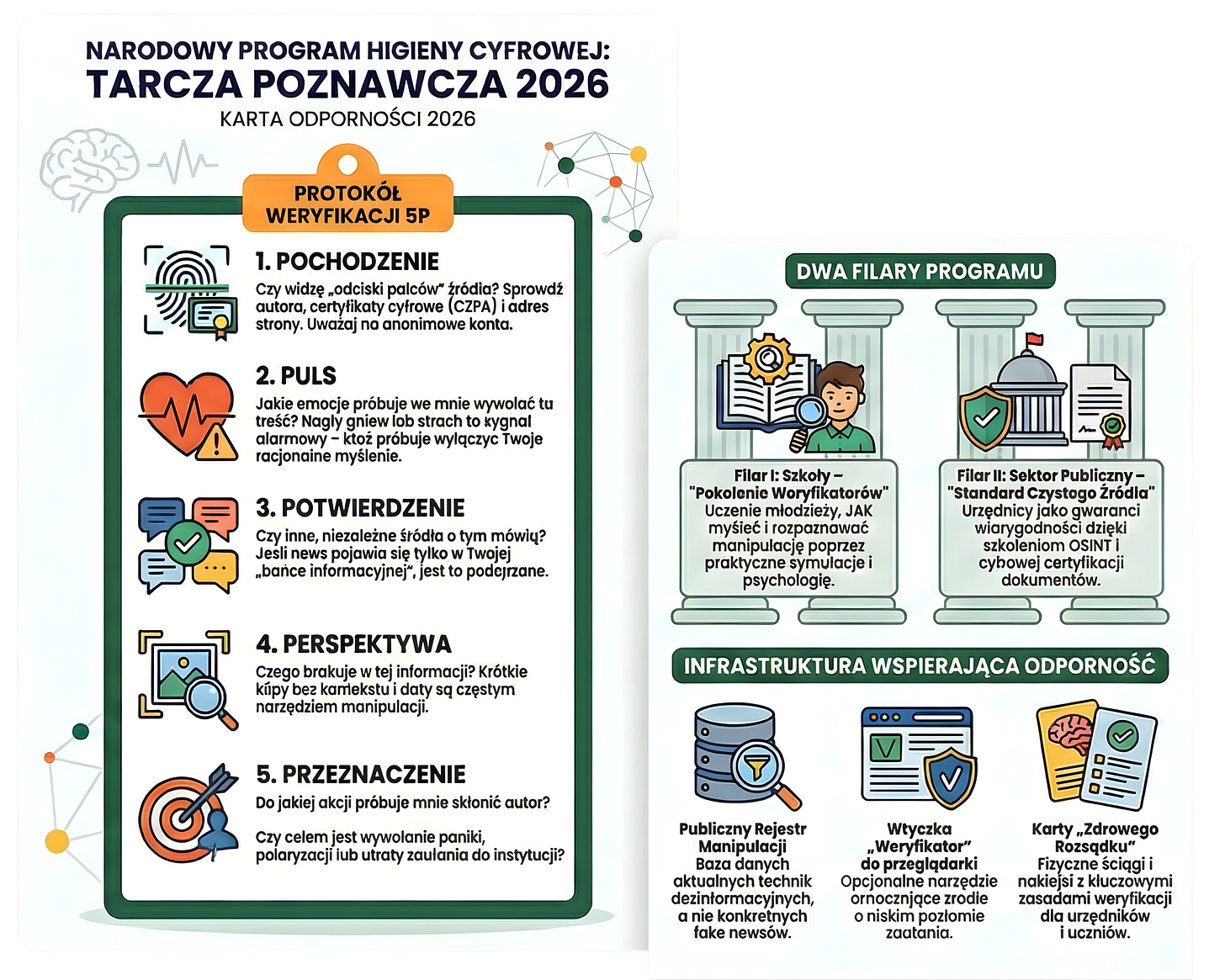

Edukacja musi odejść od teorii na rzecz praktycznych laboratoriów dezinformacji i treningów „promptowania krytycznego”. Urzędnicy i uczniowie muszą traktować informację z taką samą ostrożnością jak żywność (sprawdzając jej „skład”).

Symulacje „farm trolli” pozwalają zrozumieć psychologiczne mechanizmy wiralowości.

Standardy „Czystego Źródła” w administracji budują autorytet państwa jako gwaranta wiarygodności.

Odporność nie jest dana raz na zawsze; wymaga regularnych ćwiczeń kryzysowych i „red teamingu”.Plusy/Szanse (PL/UE)

Wzmocnienie demokracji. Budowanie świadomego społeczeństwa, które jest trudniejsze do zewnętrznej manipulacji bez ograniczania swobód obywatelskich.

Liderstwo technologiczne. Szansa dla UE na wyznaczenie globalnych standardów transparentności algorytmicznej i certyfikacji treści (C2PA).

Innowacyjna edukacja. Przekształcenie systemu szkolnictwa w model uczący procesów myślenia, a nie tylko zapamiętywania faktów.

Minusy/Ryzyka/Zagrożenia (PL/UE)

Koszty wdrożenia. Wysokie nakłady na technologię weryfikacyjną i masowe szkolenia w sektorze publicznym.

Opór platform (Big Tech). Trudności w wymuszeniu transparentności algorytmicznej na globalnych gigantach technologicznych.

Ryzyko upolitycznienia. Niebezpieczeństwo, że narzędzia fact-checkingowe wspierane przez państwo zostaną wykorzystane do walki z opozycją polityczną.

Wnioski

Wnioski krótkoterminowe (do 1 roku)

Wdrożenie Protokołu 5P jako standardu operacyjnego

Natychmiastowe wprowadzenie kwestionariusza weryfikacji (Pochodzenie, Puls, Potwierdzenie, Perspektywa, Przeznaczenie) w codziennej pracy urzędników i procesie dydaktycznym uczniów w celu przerwania automatyzmu reakcji.

Upowszechnienie zasady „10 sekund pauzy”

Inicjowanie kampanii społecznych promujących higienę cyfrową, koncentrujących się na opanowaniu emocji przed interakcją z sensacyjną treścią (tzw. „bezpiecznik poznawczy”).

Audyt procedur reagowania kryzysowego

Przegląd i aktualizacja protokołów komunikacyjnych w instytucjach publicznych pod kątem szybkości i transparentności przekazu w sytuacjach wykrycia operacji dezinformacyjnych.

Wnioski średnioterminowe (1–3 lata)

Systemowa certyfikacja pochodzenia treści (C2PA)

Obowiązkowe wdrożenie standardu „cyfrowego paszportu” dla wszystkich oficjalnych dokumentów, nagrań i komunikatów rządowych, umożliwiającego obywatelowi szybką weryfikację autentyczności.

Budowa partnerstwa z sektorem OSINT

Stworzenie stałych kanałów współpracy między państwem a niezależnymi organizacjami fact-checkingowymi i grupami wywiadu jawnoźródłowego, co zwiększa pluralizm i zaufanie do ekosystemu informacji.

Automatyzacja systemów wczesnego ostrzegania

Inwestycje w narzędzia AI rozpoznające schematy i techniki manipulacji (np. farmy trolli, deepfakes) zamiast próby manualnego prostowania każdego pojedynczego newsa.

Wnioski długoterminowe (powyżej 3 lat)

Reforma edukacyjna „Pokolenie Weryfikatorów”

Całkowite odejście od nauczania faktograficznego na rzecz kształtowania kompetencji z zakresu psychologii emocji w sieci, neurobiologii manipulacji oraz krytycznego korzystania z narzędzi AI.

Ustanowienie suwerenności poznawczej jako filaru obronności

Formalne włączenie ochrony procesów myślowych obywateli do doktryny obronnej państwa i traktowanie umysłów jako infrastruktury krytycznej.

Przemodelowanie architektury wyboru na platformach

Skuteczne wymuszenie na dostawcach technologii transparentności algorytmicznej, co trwale ograniczy wiralność treści promujących polaryzację i nienawiść.

Implikacje

Implikacje dla PL/UE

Model odporny zamiast autorytarnego: przejście od reaktywnej cenzury i usuwania treści do proaktywnego budowania kompetencji obywateli, co wzmacnia legitymację demokratyczną instytucji unijnych.

Standaryzacja bezpieczeństwa informacyjnego: konieczność stworzenia jednolitych dla całej UE protokołów transparentności algorytmicznej i certyfikacji treści syntetycznych, co może stać się nowym standardem globalnym.

Wzrost kosztów operacyjnych administracji: potrzeba znacznych nakładów na regularne ćwiczenia „Red Teaming” oraz certyfikację zaufania cyfrowego w sektorze publicznym.

Implikacje dla biznesu

Nowe wymogi transparentności dla Big Tech: firmy technologiczne będą zmuszone ujawniać mechanizmy promujące treści (algorytmy) oraz powody ich wiralności pod rygorem sankcji.

Rozwój sektora narzędzi weryfikacyjnych: wzrost zapotrzebowania na oprogramowanie typu open-source do analizy metadanych, wykrywania deepfakes oraz wtyczek przeglądarkowych filtrujących źródła o niskim zaufaniu.

Odpowiedzialność korporacyjna za higienę informacyjną: przedsiębiorstwa będą musiały wdrożyć wewnętrzne programy odporności poznawczej dla pracowników, aby chronić się przed socjotechniką i phishingiem opartym na AI.

Implikacje dla „Kowalskiego”

Konieczność samokształcenia w zakresie higieny cyfrowej: przeciętny użytkownik musi przejąć rolę „własnego redaktora”, opierając się na narzędziach takich jak Karta Odporności i Protokół 5P.

Zmiana nawyków konsumpcji treści: przejście od automatycznego, emocjonalnego przewijania (scrolling) do analitycznego podejścia „10 sekund pauzy” przed każdą reakcją online.

Odbudowa zaufania do lokalnych wspólnot: wzrost znaczenia bezpośrednich relacji międzyludzkich (offline) jako najskuteczniejszego filtra przed cyfrową manipulacją.

Podsumowanie

Odporność informacyjna nie polega na blokowaniu kłamstw, lecz na wzmocnieniu psychologicznym obywateli i wymuszeniu technologicznej przejrzystości od dostawców treści. Budowa suwerenności poznawczej wymaga transformacji państwa z cenzora w edukatora oraz obywatela z biernego odbiorcy w świadomego weryfikatora procesu informacyjnego.

Co to oznacza?

W świecie pełnym sztucznie generowanych informacji, Twoim najsilniejszym pancerzem nie są zakazy rządowe, ale Twoja własna umiejętność opanowania emocji i poświęcenia 10 sekund na sprawdzenie, skąd pochodzi dana wiadomość i co chce z Tobą zrobić.