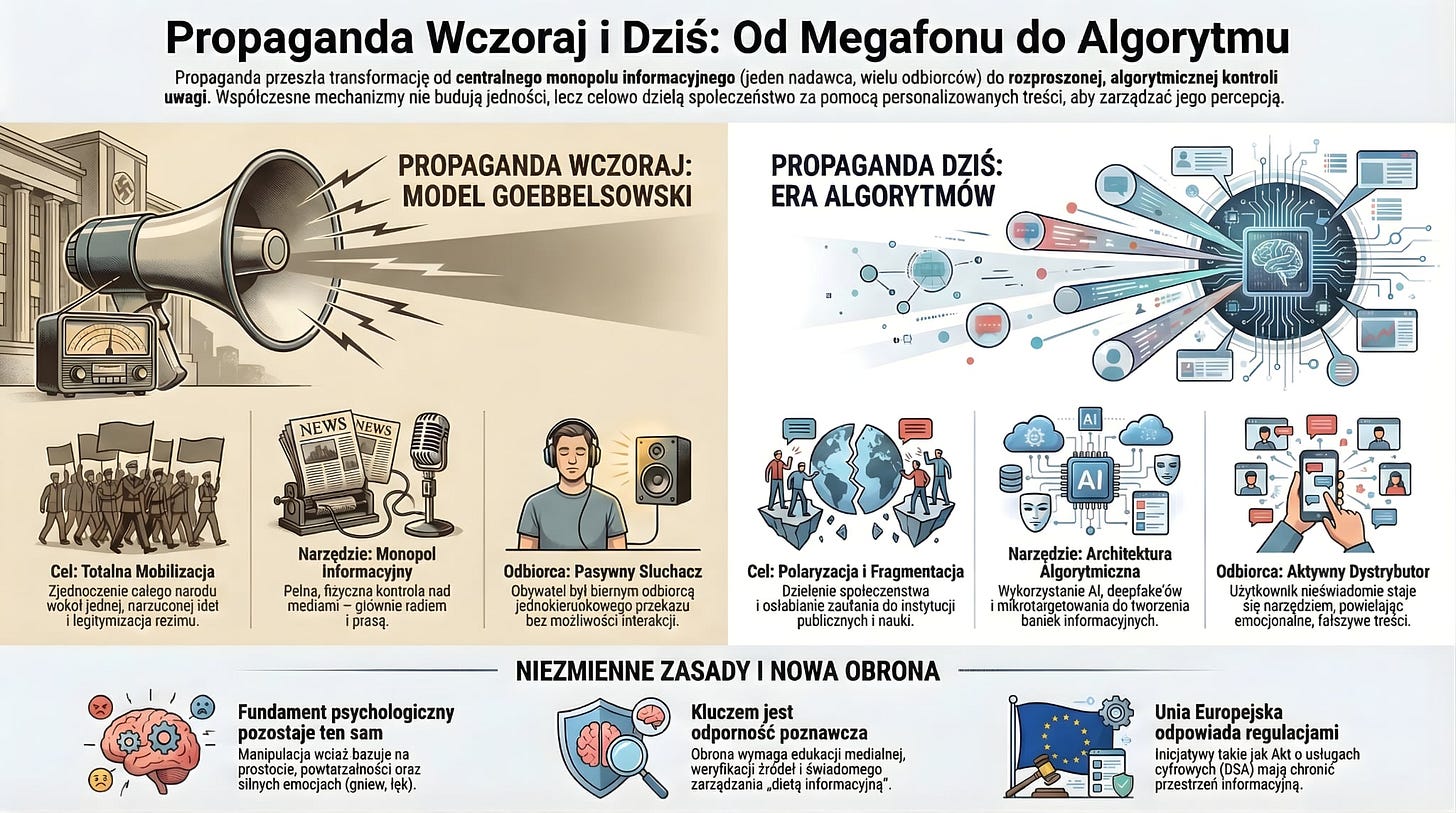

Analiza zestawia historyczne metody propagandy totalitarnej z nowoczesnymi, zdecentralizowanymi mechanizmami cyfrowymi, wskazując na trwałość psychologicznych fundamentów manipulacji przy radykalnej zmianie technologii. Współczesne systemy wykorzystują algorytmy i sztuczną inteligencję do zarządzania percepcją społeczną poprzez polaryzację i mikrotargetowanie.

Sygnał

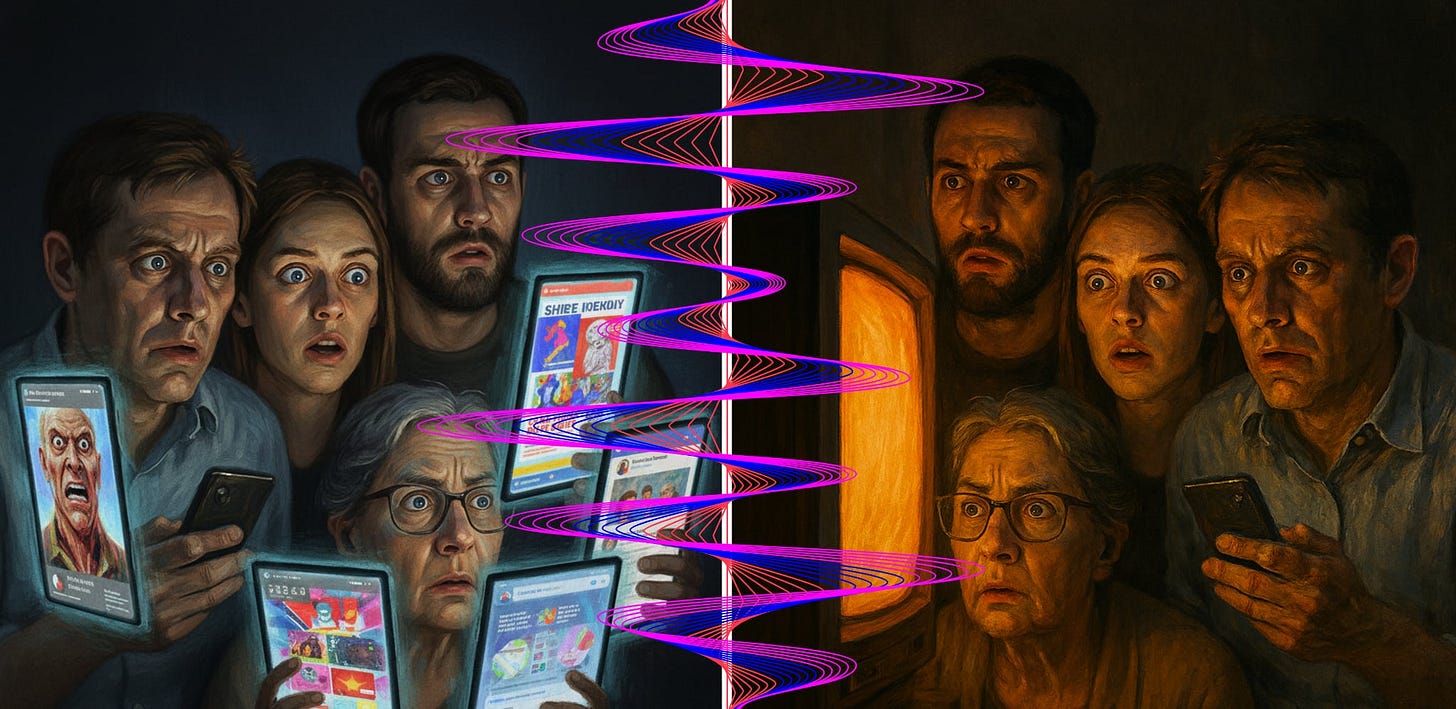

Następuje przejście od centralnego monopolu informacyjnego do rozproszonej, algorytmicznej kontroli uwagi, która fragmentuje społeczeństwo.

Innymi słowy: kiedyś jeden nadawca mówił to samo do wszystkich, a dziś tysiące algorytmów podsuwają każdemu z nas coś innego, żeby zatrzymać naszą uwagę.

Kontekst

Propaganda ewoluowała od państwowej kontroli mediów tradycyjnych w III Rzeszy do współczesnego wykorzystania platform społecznościowych i systemów rekomendacji. W 2024 i 2025 roku odnotowano gwałtowny wzrost wykorzystania sztucznej inteligencji, w tym deepfake’ów, w kampaniach dezinformacyjnych wpływających na procesy wyborcze. Unia Europejska w odpowiedzi wdraża regulacje takie jak Akt o usługach cyfrowych (DSA) oraz inicjatywę Europejskiej Tarczy Demokracji.

Analiza

Transformacja celów operacyjnych

Współczesna propaganda odeszła od goebbelsowskiego modelu totalnej mobilizacji wokół jednej idei na rzecz zarządzania percepcją poprzez polaryzację. Zamiast tworzyć jednolity naród, nowoczesne mechanizmy dążą do fragmentacji i osłabienia zaufania do instytucji.

System Goebbelsa legitymizował reżim i eliminował opozycję poprzez monopol informacyjny.

Współczesne działania (FIMI) służą delegitymizacji przeciwników i budowaniu emocjonalnych ram interpretacyjnych w warunkach pluralizmu.

Fragmentacja społeczeństwa utrudnia prowadzenie racjonalnej debaty publicznej.Trwałość mechanizmów psychologicznych

Mimo zmiany technologii, fundamenty wpływu (prostota przekazu, emocjonalność i powtarzalność) pozostają niezmienne od czasów III Rzeszy. Propaganda nadal opiera się na wskazywaniu wroga i bazowaniu na lęku oraz gniewie.

Emocje takie jak gniew (31%) i lęk (24%) są najskuteczniejszymi nośnikami zasięgów w mediach społecznościowych.

Proste, powtarzalne komunikaty szybciej zapadają w pamięć i są rzadziej poddawane krytycznej weryfikacji.

Algorytmy mediów społecznościowych naturalnie premiują treści polaryzujące, co wzmacnia stare techniki manipulacji.Od monopolu do architektury algorytmicznej

W przeszłości propaganda wymagała fizycznej kontroli nad radiem i prasą; dziś opiera się na niewidocznych algorytmach selekcjonujących treści. To przejście oznacza utratę przez państwo monopolu na rzecz globalnych korporacji technologicznych.

Goebbels wykorzystywał „odbiornik ludowy” do jednokierunkowej transmisji przekazu.

Dzisiejsze systemy rekomendacji tworzą bańki informacyjne, izolując użytkowników od odmiennych punktów widzenia.

Algorytmy kierują się potencjałem angażującym, a nie wartością merytoryczną informacji.Rola sztucznej inteligencji i deepfake’ów

Rok 2025 przyniósł „eksplozję” kryzysów związanych z treściami generowanymi przez AI, które są niemal niemożliwe do natychmiastowej weryfikacji. Technologia ta pozwala na masową produkcję wiarygodnie wyglądających fałszywych materiałów audio-wideo.

Deepfake’i są wykorzystywane do podszywania się pod liderów politycznych i ekspertów w celu manipulacji wyborcami.

AI umożliwia automatyzację tworzenia dezinformacji, co drastycznie obniża koszty prowadzenia operacji wpływów.

Edukacja społeczeństwa nie nadąża za tempem rozwoju nieetycznej technologii AI.Precyzja mikrotargetowania

W przeciwieństwie do masowego przekazu Goebbelsa, współczesna propaganda uderza w konkretne lęki i potrzeby wąskich grup odbiorców. Wykorzystanie danych o użytkownikach pozwala na personalizację manipulacji.

Analiza danych historycznych i statystyk (analityka predykcyjna) pozwala przewidywać reakcje grup społecznych na konkretne bodźce.

Przekaz jest dopasowywany do „plemiennej wiedzy” danej bańki informacyjnej, co zwiększa jego skuteczność.

Mikrotargetowanie sprawia, że dezinformacja staje się niewidoczna dla osób spoza docelowej grupy.Nowa rola odbiorcy: prosumpcja manipulacji

Odbiorca propagandy totalitarnej był pasywnym słuchaczem; współczesny użytkownik internetu jest aktywnym dystrybutorem treści (prosumentem). Udostępnianie emocjonalnych postów sprawia, że obywatele nieświadomie stają się narzędziami propagandy.

Mechanizmy viralowe opierają się na dobrowolnym powielaniu przekazu przez użytkowników szukających potwierdzenia własnych przekonań.

Brak weryfikacji źródeł przed udostępnieniem treści ułatwia szybkie rozprzestrzenianie się fake newsów.

Automatyczne udostępnianie treści emocjonalnych jest jedną z głównych przyczyn destabilizacji debaty publicznej.Wojna kognitywna i FIMI

W 2025 roku dezinformacja jest traktowana jako element wojny kognitywnej, gdzie polem bitwy staje się umysł obywatela. Unia Europejska definiuje to jako FIMI (Foreign Information Manipulation and Interference).

Operacje informacyjne mają na celu wzbudzenie nieufności wobec instytucji publicznych i wzajemnej wrogości obywateli.

Wrogie państwa wykorzystują „fabryki trolli” i boty do wpływania na wyniki wyborów w krajach demokratycznych.

Zamęt informacyjny jest równie skuteczną bronią, co bezpośrednia manipulacja faktami.Erozja prawdy i “cherry picking”

Technika selektywnego wybierania faktów (cherry picking) służy do budowania narracji, które są formalnie prawdziwe, ale merytorycznie kłamliwe. Prowadzi to do powstania równoległych rzeczywistości informacyjnych.

Ignorowanie kontekstu pozwala na kreowanie fałszywych związków przyczynowo-skutkowych, np. w tematach zdrowotnych czy klimatycznych.

W bańkach informacyjnych powtarzalność fałszywych narracji stabilizuje je jako „niepodważalne fakty”.

Zjawisko to prowadzi do moralnego zobojętnienia i akceptacji radykalnych rozwiązań.Mechanizmy kontroli od cenzury do algorytmu

Goebbels polegał na fizycznej cenzurze; dzisiejsza kontrola jest „miękka” i polega na ograniczaniu zasięgów (shadowbanning) lub promowaniu wybranych narracji. Algorytmy platform takich jak X mogą faworyzować konkretne opcje polityczne.

Platformy cyfrowe decydują o tym, co staje się widoczne, poprzez protokoły reagowania na incydenty i moderację treści.

Użytkownik nie ma wglądu w powody, dla których widzi określone treści, co tworzy złudzenie obiektywizmu.

Transparentność algorytmów staje się istotnym elementem stabilności społecznej.Ekonomia uwagi i clickbait

Współczesna propaganda jest silnie powiązana z modelem biznesowym mediów cyfrowych, gdzie uwaga użytkownika jest monetyzowana. Sensacyjne nagłówki (clickbait) służą przyciągnięciu uwagi kosztem rzetelności.

Dezinformacja generuje większy ruch na stronach, co przekłada się na wyższe zyski z reklam dla platform i twórców fałszywych treści.

W pogoni za kliknięciami media tradycyjne często przejmują emocjonalny język charakterystyczny dla propagandy.

Rynek e-commerce również wykorzystuje te mechanizmy do personalizacji zakupów i manipulacji konsumentem.Instytucjonalna odporność: Europejska Tarcza Demokracji

W obliczu zagrożeń, w 2025 roku KE przedstawiła projekt Europejskiej Tarczy Demokracji, mający na celu ochronę przestrzeni informacyjnej. Inicjatywa ta łączy rozwiązania prawne, edukacyjne i technologiczne.

Powstanie ogólnoeuropejskiej sieci fact-checkerów ma umożliwić szybkie reagowanie na operacje FIMI.

Akt o sztucznej inteligencji wprowadza obowiązek oznaczania treści generowanych przez AI, aby ułatwić ich identyfikację.

Skuteczność tych działań zależy od woli politycznej i współpracy państw członkowskich.Edukacja medialna jako tarcza obywatelska

Długofalowa ochrona przed propagandą wymaga wzmacniania autonomii poznawczej obywateli poprzez edukację medialną. Krytyczne myślenie staje się niezbędną umiejętnością w świecie cyfrowym.

Młodzi ludzie, mimo biegłości technologicznej, są najbardziej podatni na fake newsy ze względu na nadmierne zaufanie do mediów społecznościowych.

Świadome zarządzanie własną „dietą informacyjną” pozwala na unikanie manipulacji emocjonalnej.

Odporność informacyjna nie powstaje w izolacji – wymaga współpracy nauki, mediów i organizacji pozarządowych.Plusy/Szanse (PL/UE)

Rozwój technologii fact-checkingowych: wykorzystanie AI do automatycznej weryfikacji kłamstw w czasie rzeczywistym.

Budowa wspólnych standardów regulacyjnych: wprowadzenie DSA i Aktu o AI jako fundamentu bezpiecznej przestrzeni cyfrowej w całej UE.

Wzrost świadomości społecznej: 84% Polaków deklaruje kontakt z fake newsami, co może stanowić impuls do nauki krytycznego myślenia.

Europejska Tarcza Demokracji: stworzenie instytucjonalnych mechanizmów ochrony przed zagranicznymi ingerencjami (FIMI).

Minusy/Ryzyka/Zagrożenia (PL/UE)

Głęboka polaryzacja społeczna: utrata zdolności do kompromisu i degradacja debaty publicznej.

Erozja zaufania do instytucji: systemowe podważanie wiarygodności państwa, nauki i wolnych mediów.

Wyścig zbrojeń w dziedzinie AI: dezinformacja generatywna rozwija się szybciej niż narzędzia do jej wykrywania.

Zagrożenie dla procesów wyborczych: ryzyko manipulacji wynikami głosowań poprzez ukryte kampanie mikrotargetowane i boty.

Wnioski

Wnioski krótkoterminowe

Szybkość i intensywność oddziaływania

Współczesne działania propagandowe cechują się znacznie większą dynamiką niż modele historyczne, co pozwala na niemal natychmiastowe reagowanie na wydarzenia.

Emocjonalna dominacja przestrzeni publicznej

Narracje oparte na silnych afektach (gniew, lęk) błyskawicznie przejmują kontrolę nad dyskursem, spychając merytoryczne argumenty na margines.

Błyskawiczna polaryzacja grupowa

Społeczeństwo ulega gwałtownym podziałom na zwalczające się obozy informacyjne już w pierwszych godzinach po zaistnieniu danego impulsu.

Wnioski średnioterminowe

Algorytmiczne utrwalanie radykalizacji

Systemy rekomendacji w sposób ciągły wzmacniają skrajne postawy, uniemożliwiając użytkownikom kontakt z umiarkowanymi punktami widzenia.

Stabilizacja baniek informacyjnych

Długotrwała ekspozycja na jednostronne treści prowadzi do powstania trwałych struktur izolacji poznawczej, które trudno przełamać faktami.

Systemowa erozja zaufania społecznego

Powtarzalność kłamstw i kampanii dezinformacyjnych trwale niszczy wiarę w instytucje publiczne, media oraz autorytety naukowe.

Wnioski długoterminowe

Trwała fragmentacja tkanki społecznej

Rozpad wspólnoty narodowej na odizolowane od siebie „plemiona” informacyjne staje się cechą stałą, a nie przejściową.

Degradacja racjonalnej debaty publicznej

Utrata zdolności do merytorycznego dialogu prowadzi do paraliżu procesów demokratycznych i braku możliwości wypracowania kompromisów.

Koncentracja władzy nad percepcją

Zarówno rządy, jak i globalne korporacje technologiczne uzyskują niebezpieczną zdolność do modelowania rzeczywistości, w której funkcjonują obywatele.

Implikacje

Implikacje dla PL/UE

Budowa odporności poprzez edukację medialną. Najważniejszym zadaniem państwa jest wdrożenie systemowych programów nauczania higieny cyfrowej i krytycznego myślenia.

Uznanie politycznej roli algorytmów. Instytucje unijne muszą traktować mechanizmy sterowania uwagą jako istotnych aktorów wpływających na bezpieczeństwo i stabilność regionu.

Wymóg transparentności komunikacji. Utrzymanie stabilności społecznej wymaga od organów publicznych pełnej jawności w procesach informacyjnych i odpieraniu narracji FIMI.

Zapobieganie destabilizacji państwa. Nadużywanie technik propagandowych wewnątrz kraju prowadzi do długofalowej utraty zaufania do systemu prawnego i demokratycznego.

Implikacje dla biznesu

Zarządzanie ryzykiem dezinformacyjnym. Firmy muszą budować systemy monitorowania sieci w celu ochrony przed atakami typu deepfake, które mogą zrujnować markę w kilka minut.

Odpowiedzialność za architekturę wyboru. Platformy cyfrowe i firmy e-commerce stoją przed wyborem między maksymalizacją zysku z zaangażowania a etycznym projektowaniem algorytmów.

Konieczność autentyczności w komunikacji. W świecie przesyconym manipulacją, dla konsumenta najwyższą wartością biznesową staje się rzetelność i transparentność pochodzenia informacji.

Implikacje dla „Kowalskiego”

Aktywne zarządzanie dietą informacyjną. Obywatel musi przejąć kontrolę nad tym, skąd czerpie wiedzę, zamiast biernie przyjmować treści podpowiadane przez system.

Trening autonomii poznawczej. Ciągła weryfikacja źródeł i dystans wobec sensacyjnych nagłówków stają się niezbędnymi narzędziami przetrwania w cyfrowym świecie.

Rezygnacja z automatyzmu udostępniania. Każdy użytkownik musi powstrzymać się od przesyłania dalej treści budzących nagły gniew lub euforię bez ich uprzedniego sprawdzenia.

Zrozumienie technicznych mechanizmów wpływu. Świadomość tego, jak działają algorytmy, jest pierwszym krokiem do zyskania odporności na manipulację.

Podsumowanie

Współczesna propaganda, ewoluując od centralnego monopolu do rozproszonej kontroli algorytmicznej, przekształciła się w system stałego zarządzania percepcją, który wymaga od państw, biznesu i jednostek budowy radykalnie nowych mechanizmów odporności poznawczej.

Analiza porównawcza wykazuje, że choć narzędzia propagandy ewoluowały od monopolu radiowego do rozproszonych algorytmów AI, jej psychologiczne jądro (bazujące na emocjach i prostocie) pozostaje niezmienne. Współczesne zagrożenia, takie jak deepfake’i i mikrotargetowanie, wymagają nie tylko regulacji prawnych (DSA, Akt o AI), ale przede wszystkim odbudowy zaufania społecznego i edukacji medialnej.

Co to oznacza?

Dzisiejsi manipulatorzy nie muszą już zakazywać czytania gazet. Wystarczy, że zasypią nas taką ilością sprzecznych i emocjonalnych informacji w internecie, że przestaniemy wierzyć w jakąkolwiek prawdę i zaczniemy kłócić się z sąsiadami. Aby się przed tym bronić, musimy nauczyć się rozpoznawać sztuczne nagrania i dwa razy pomyśleć, zanim podamy dalej coś, co wywołuje w nas nagłą złość lub strach.