Prywatne systemy Sztucznej Inteligencji. Jak zbudować własne AI w domu lub firmie?

Kompleksowa analiza możliwości, narzędzi i architektury lokalnych modeli AI działających bez chmury i bez utraty kontroli nad danymi.

Sygnał

W obliczu rosnącej zależności od komercyjnych usług AI coraz większego znaczenia nabiera możliwość stworzenia własnego, lokalnego systemu sztucznej inteligencji. To nie tylko sposób na obniżenie kosztów, ale przede wszystkim na odzyskanie pełnej kontroli nad danymi i procesami, które decydują o bezpieczeństwie organizacji.

Analiza: Jak stworzyć własny system AI działający lokalnie w domu lub firmie

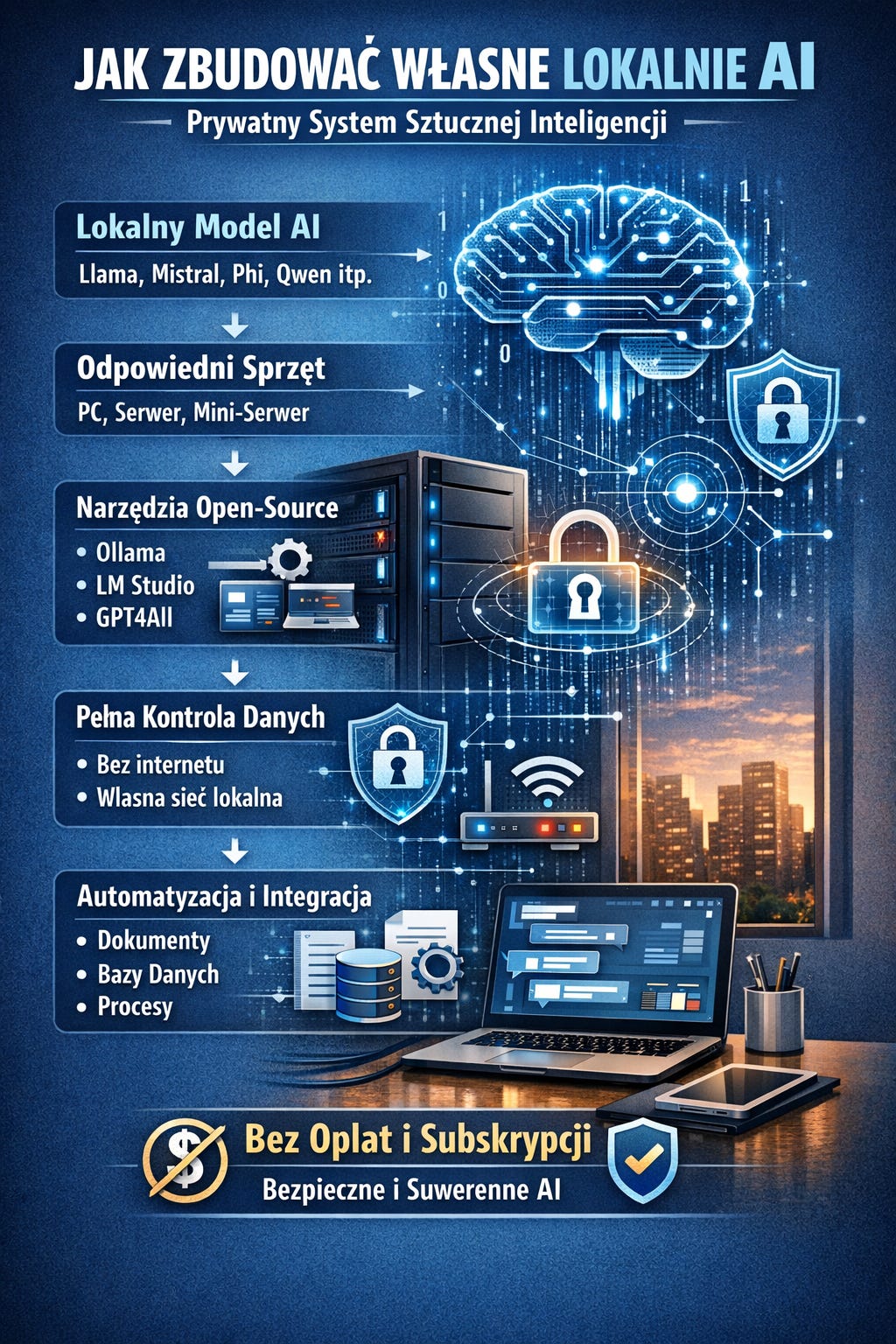

Coraz więcej organizacji i użytkowników indywidualnych chce korzystać z zaawansowanej sztucznej inteligencji, ale bez konieczności wysyłania danych do zewnętrznych dostawców. Powody są jasne: poufność, bezpieczeństwo, koszty oraz pełna kontrola nad modelem. Własny system AI — działający lokalnie, na komputerze, serwerze lub urządzeniu edge — staje się realną alternatywą dla komercyjnych usług takich jak ChatGPT, Gemini czy Claude. Kluczowe jest zrozumienie, jakie elementy są potrzebne, jak wygląda architektura takiego rozwiązania i jakie narzędzia umożliwiają jego wdrożenie.

Fundament: lokalny model językowy (LLM)

Podstawą prywatnego systemu AI jest model, który można uruchomić na własnym sprzęcie. W ostatnich latach pojawiły się modele open‑source, które osiągają jakość zbliżoną do komercyjnych rozwiązań, a jednocześnie nie wymagają wysyłania danych do chmury. Modele takie jak Llama, Mistral, Phi czy Qwen są dostępne w wersjach zoptymalizowanych do pracy na zwykłych komputerach. Dzięki technikom kwantyzacji modele mogą działać nawet na laptopach z 16–32 GB RAM. W firmach można wykorzystać mocniejsze serwery lub stacje robocze z kartami graficznymi, co pozwala na obsługę większych modeli i bardziej wymagających zadań.

Architektura lokalnego systemu AI

Własny system AI składa się z kilku warstw. Pierwsza to sam model, który odpowiada za generowanie tekstu, analizę danych czy automatyzację procesów. Druga to warstwa uruchomieniowa — oprogramowanie, które pozwala modelowi działać na lokalnym sprzęcie. Trzecia to interfejs użytkownika, który umożliwia wygodną pracę: panel webowy, aplikacja desktopowa lub integracja z firmowymi narzędziami. Całość działa w obrębie sieci lokalnej, co oznacza, że żadne dane nie opuszczają firmy lub domu. Taki układ pozwala zachować pełną poufność, a jednocześnie daje możliwość dostosowania systemu do własnych potrzeb.

Sprzęt: gdzie powinien stać model?

W domu model może działać na mocniejszym komputerze stacjonarnym, mini‑serwerze typu Intel NUC, a nawet na laptopie, jeśli zadania nie są zbyt wymagające. W firmie najczęściej stosuje się serwer z kartą graficzną (np. NVIDIA RTX/Quadro), który pełni rolę centralnego węzła AI. Taki serwer może obsługiwać wielu użytkowników jednocześnie, a dostęp odbywa się przez przeglądarkę lub API. Ważne jest, aby urządzenie znajdowało się w sieci lokalnej — dzięki temu wszystkie dane, zapytania i dokumenty pozostają wewnątrz organizacji. W przypadku szczególnie wrażliwych danych można dodatkowo odizolować serwer od internetu.

Bezpieczeństwo i pełna kontrola nad danymi

Lokalny system AI eliminuje ryzyko wycieku danych do zewnętrznych dostawców. Cała komunikacja odbywa się w ramach infrastruktury, którą kontroluje użytkownik. Można wdrożyć własne polityki bezpieczeństwa, szyfrowanie, kontrolę dostępu oraz logowanie aktywności. W firmach szczególnie istotne jest to, że model nie uczy się na danych użytkowników, chyba że zostanie to świadomie skonfigurowane. W przeciwieństwie do usług chmurowych, lokalny system nie wysyła żadnych metadanych, historii rozmów ani dokumentów do producenta modelu.

Narzędzia do samodzielnego postawienia prywatnego AI

Istnieje kilka dojrzałych narzędzi, które pozwalają uruchomić modele AI lokalnie, bez konieczności posiadania specjalistycznej wiedzy. Ollama umożliwia pobieranie i uruchamianie modeli jednym poleceniem, a także integrację z aplikacjami. LM Studio oferuje wygodny interfejs graficzny i obsługuje wiele modeli open‑source. Oobabooga (Text Generation WebUI) to rozbudowane środowisko dla bardziej zaawansowanych użytkowników, pozwalające na pełną kontrolę nad parametrami modelu. Do tego dochodzą narzędzia takie jak GPT4All, które są lekkie i idealne do użytku domowego. Wszystkie te rozwiązania działają offline i nie wymagają żadnych opłat.

Możliwości rozbudowy i personalizacji

Własny system AI można dostosować do specyficznych potrzeb: trenować na firmowych dokumentach, integrować z bazami danych, automatyzować procesy lub tworzyć własne agenty wykonujące zadania. Dzięki temu AI staje się nie tylko narzędziem do rozmowy, ale realnym wsparciem operacyjnym. W firmach można wdrożyć wiele modeli jednocześnie — jeden do analizy dokumentów, drugi do generowania treści, trzeci do automatyzacji workflow. Wszystko działa lokalnie i pod pełną kontrolą.

Wnioski

Wnioski krótkoterminowe (0–6 miesięcy)

Najbliższy okres pozwala na szybkie wdrożenie podstawowego, lokalnego systemu AI bez dużych nakładów finansowych. Dostępne modele open‑source — takie jak Llama, Mistral, Phi czy Qwen — umożliwiają uruchomienie funkcjonalnego asystenta na zwykłym komputerze lub serwerze domowym. Narzędzia typu Ollama, LM Studio czy GPT4All pozwalają na natychmiastowe rozpoczęcie pracy, bez konieczności posiadania specjalistycznej wiedzy. W tym czasie możliwe jest również przetestowanie różnych modeli, określenie ich wydajności oraz dopasowanie konfiguracji do potrzeb użytkownika lub firmy. Najważniejszym krótkoterminowym efektem jest uzyskanie pełnej kontroli nad danymi i wyeliminowanie konieczności korzystania z usług chmurowych.

Wnioski średnioterminowe (6–18 miesięcy)

W perspektywie średnioterminowej lokalny system AI może zostać rozbudowany o funkcje, które realnie wpływają na produktywność i automatyzację procesów. Możliwe jest wdrożenie integracji z firmowymi dokumentami, bazami danych, systemami workflow oraz narzędziami operacyjnymi. W tym czasie organizacja może również zainwestować w mocniejszy sprzęt — np. serwer z kartą graficzną — co pozwoli na obsługę większych modeli i wielu użytkowników jednocześnie. System staje się nie tylko narzędziem do generowania tekstu, ale pełnoprawnym elementem infrastruktury wspierającej analizę danych, raportowanie, tworzenie treści i automatyzację zadań. W tym okresie rośnie także kompetencja użytkowników w zakresie pracy z AI, co zwiększa efektywność całego rozwiązania.

Wnioski długoterminowe (18 miesięcy i dalej)

W dłuższej perspektywie własny system AI może stać się strategicznym zasobem organizacji lub gospodarstwa domowego. Rozwiązania lokalne zapewniają pełną suwerenność nad danymi, co jest kluczowe w kontekście rosnących wymagań dotyczących prywatności i bezpieczeństwa. Możliwe jest tworzenie własnych modeli wyspecjalizowanych w konkretnych zadaniach, trenowanych na wewnętrznych danych, co daje przewagę konkurencyjną i unikalne kompetencje. System może zostać rozbudowany o agentów wykonujących złożone operacje, automatyzujących procesy biznesowe i wspierających decyzje. W długim horyzoncie lokalne AI staje się fundamentem cyfrowej niezależności — uniezależnia od dostawców chmurowych, eliminuje koszty subskrypcji i pozwala budować rozwiązania w pełni dopasowane do potrzeb użytkownika.

Implikacje

Implikacje dla Państwa

Upowszechnienie lokalnych systemów AI niesie dla państwa zarówno szanse, jak i wyzwania. Z jednej strony rośnie potrzeba stworzenia ram prawnych, które umożliwią obywatelom i firmom bezpieczne korzystanie z modeli działających poza chmurą, bez nadmiernej biurokracji i ograniczeń. Państwo musi przygotować regulacje dotyczące przechowywania danych, audytowalności modeli oraz odpowiedzialności za ich działanie, jednocześnie nie blokując innowacji. Z drugiej strony lokalne AI może stać się narzędziem wzmacniającym suwerenność cyfrową kraju — administracja publiczna może wykorzystywać modele działające na własnych serwerach, bez ryzyka wycieku danych do zagranicznych dostawców. W dłuższej perspektywie państwo będzie musiało inwestować w edukację cyfrową, aby obywatele i instytucje potrafili świadomie korzystać z prywatnych systemów AI.

Implikacje dla Biznesu

Dla przedsiębiorstw lokalne AI oznacza możliwość budowania przewagi konkurencyjnej poprzez pełną kontrolę nad danymi i procesami. Firmy mogą wdrażać modele dopasowane do własnych potrzeb, trenowane na wewnętrznych dokumentach i procedurach, co pozwala tworzyć rozwiązania niedostępne w komercyjnych usługach chmurowych. Jednocześnie rośnie odpowiedzialność za bezpieczeństwo — skoro dane nie opuszczają organizacji, to firma musi zadbać o właściwą infrastrukturę, polityki dostępu i ochronę przed nadużyciami. W perspektywie średnioterminowej przedsiębiorstwa mogą znacząco obniżyć koszty, eliminując subskrypcje SaaS i budując własne, skalowalne środowiska AI. W długim horyzoncie lokalne modele staną się integralną częścią procesów operacyjnych, automatyzacji i analityki, a firmy, które nie wdrożą takich rozwiązań, mogą stracić konkurencyjność.

Implikacje dla zwykłego Kowalskiego

Dla przeciętnego użytkownika możliwość uruchomienia własnego AI w domu oznacza większą prywatność, niezależność i bezpieczeństwo. Kowalski nie musi już obawiać się, że jego zapytania, dokumenty czy prywatne notatki trafiają na serwery wielkich korporacji. Lokalne modele pozwalają na tworzenie osobistych asystentów, narzędzi do nauki, organizacji życia czy pracy twórczej — wszystko offline, bez opłat i bez śledzenia. Jednocześnie pojawia się potrzeba podstawowej edukacji technologicznej: użytkownik musi zrozumieć, jak działa model, jak go aktualizować i jak dbać o bezpieczeństwo danych. W dłuższej perspektywie prywatne AI może stać się tak samo powszechne jak komputer czy smartfon, a użytkownicy zyskają większą autonomię w świecie cyfrowym, w którym dotąd dominowały scentralizowane platformy.

Podsumowanie

Rozwój otwartych modeli językowych sprawił, że stworzenie własnego systemu AI działającego lokalnie stało się realne zarówno dla firm, jak i użytkowników domowych. Uruchomienie modelu na własnym sprzęcie pozwala zachować pełną kontrolę nad danymi i uniezależnić się od komercyjnych usług chmurowych. Dzięki narzędziom takim jak Ollama, LM Studio czy GPT4All możliwe jest szybkie wdrożenie funkcjonalnego asystenta AI bez ponoszenia kosztów subskrypcji. W perspektywie średnio- i długoterminowej lokalne systemy AI mogą stać się fundamentem automatyzacji, analizy danych i cyfrowej suwerenności organizacji. W efekcie prywatne AI staje się nie tylko alternatywą dla ChatGPT czy Gemini, ale strategicznym zasobem budującym niezależność i przewagę użytkownika.