Synteza chaosu. Strategiczna odporność w erze autonomicznej manipulacji

Od historycznych schematów po komercyjne usługi CyberTrollingu czyli jak przetrwać w świecie, w którym prawda stała się zasobem deficytowym.

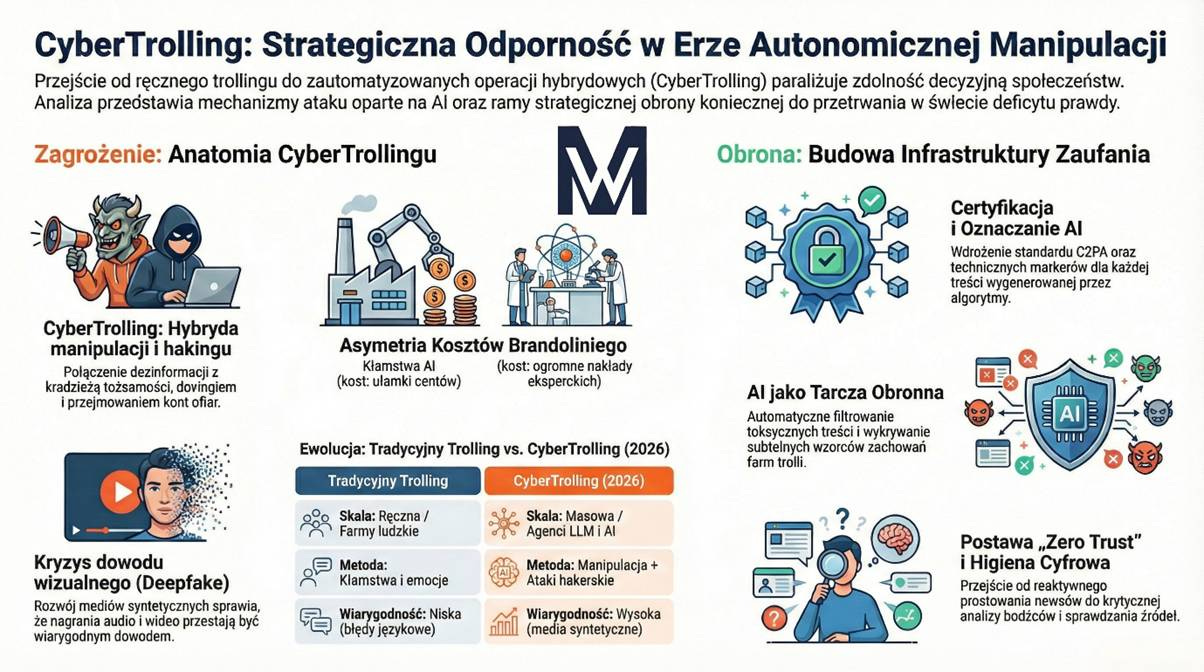

Przejście od ręcznego trollingu do zautomatyzowanych operacji hybrydowych (CyberTrolling) stanowi fundamentalne wyzwanie dla stabilności demokratycznej i rynkowej. Skuteczna obrona wymaga balansu między technologiczną weryfikacją a ochroną prywatności obywateli przed nadmiarową inwigilacją.

Zastrzeżenia

Charakter analizy. Niniejsza analiza stanowi syntezę trendów technologicznych roku 2026. Przedstawione scenariusze mają charakter strategicznych prognoz.

Asymetria detekcji. Metody generowania treści syntetycznych rozwijają się szybciej niż narzędzia ich wykrywania; brak oznaczenia „AI” nie gwarantuje autentyczności materiału.

Kontekst historyczny. Odniesienia do dawnych technik manipulacji służą analizie trwałych błędów poznawczych, a nie legitymizacji treści radykalnych.

Zastrzeżenie o lokalnych modelach (SLMs). Analiza koncentruje się na dużych systemach AI, jednak należy pamiętać o rosnącym zagrożeniu ze strony małych, lokalnych modeli językowych (SLMs), które działają bez filtrów bezpieczeństwa na prywatnym sprzęcie agresorów.

Sygnał

Ewolucja od „walki na kłamstwa” do „wojny o infrastrukturę zaufania”, gdzie celem agresora jest trwałe sparaliżowanie zdolności decyzyjnych społeczeństwa.

Kontekst

W latach 2024–2025 powszechna adopcja generatywnej AI umożliwiła masową produkcję spersonalizowanej dezinformacji. Unia Europejska zareagowała wdrożeniem AI Act oraz promowaniem standardów uwierzytelniania treści, starając się opanować zalew mediów syntetycznych.

Analiza

Mechanizmy dehumanizacji i teorie spiskowe

Współczesne kampanie bazują na sprawdzonych historycznie schematach wskazywania „ukrytego wroga”. Wykorzystuje się naturalną potrzebę umysłu do znajdowania prostych wyjaśnień dla złożonych kryzysów ekonomicznych czy klimatycznych.

Silny ładunek emocjonalny ułatwia wiralność treści.

Podział na „my” i „oni” skutecznie polaryzuje elektoraty.

To najstarsza metoda, która w cyfrowym środowisku zyskuje niespotykaną wcześniej dynamikę.Industrializacja dezinformacji. Scentralizowane farmy

Trolling przestał być hobby, a stał się zawodem wykonywanym w zhierarchizowanych strukturach (farmach). Pozwala to na prowadzenie operacji o zasięgu globalnym przy minimalnym nakładzie finansowym na jednego odbiorcę.

System zmianowy zapewnia ciągłość ataku informacyjnego.

Masowość kont kontrolowanych przez farmy tworzy iluzję powszechnego poparcia (astroturfing).

Farmy trolli są dziś standardowym elementem prowadzenia wojen hybrydowych.CyberTrolling. Połączenie manipulacji z hakingiem

To zaawansowana forma agresji, w której dezinformacja jest wspierana przez ataki na konta ofiar, wycieki danych (doxing) i przejmowanie tożsamości. Trolle nie tylko piszą, ale aktywnie niszczą cyfrowe bezpieczeństwo oponentów.

Prawdziwe dane ofiary drastycznie zwiększają wiarygodność preparowanych oszczerstw.

Strach przed cyberatakiem skutecznie ucisza głosy krytyczne.

Granica między operacją informacyjną a cyberprzestępstwem uległa zatarciu.Syntetyczne media i kryzys dowodu wizualnego

Rozwój Deepfake wideo i audio sprawia, że nagrania przestają być wiarygodnym dowodem w debacie publicznej. CyberTrolling wykorzystuje to do dyskredytowania liderów lub wywoływania paniki w czasie rzeczywistym.

Mózg reaguje na obraz i dźwięk silniej niż na tekst.

Zjawisko „dywidendy kłamcy” pozwala politykom zaprzeczać prawdziwym nagraniom, nazywając je sztucznymi.

Podważa to fundamenty materiału dowodowego w dziennikarstwie i sądownictwie.Perswazja konwersacyjna. Agenci LLM

Nowoczesne boty potrafią prowadzić logiczne i uprzejme dyskusje, budując relację z użytkownikiem. Takie AI nie spamuje, lecz cierpliwie przesuwa granice akceptacji ofiary dla określonych ideologii.

Personalizacja argumentów pod konkretnego rozmówcę zwiększa skuteczność indoktrynacji.

Brak błędów językowych buduje fałszywe poczucie autorytetu bota.

Identyfikacja takiego rozmówcy jako algorytmu jest dla człowieka niemal niemożliwa.AI jako tarcza obronna. Automatyczna detekcja

Sztuczna inteligencja jest istotnym narzędziem w rękach moderatorów i służb bezpieczeństwa. Pozwala na identyfikację botnetów i filtrowanie toksycznych treści w skali, której nie podołaliby ludzie.

Szybkość reakcji na skoordynowane ataki wzrasta wielokrotnie.

AI potrafi wykryć subtelne wzorce zachowań charakterystyczne dla farm trolli.

Jest to ciągły wyścig zbrojeń, w którym obrona musi stale adaptować się do nowych metod ataku.Aspekt psychologiczny moderatorów (Human-in-the-loop)

Miliony treści wciąż muszą weryfikować ludzie. Koszt psychiczny (zespół stresu pourazowego) u osób czyszczących sieć z najgorszych przejawów CyberTrollingu jest przemilczanym „kosztem operacyjnym” tej wojny.Ekonomia uwagi. Modele biznesowe platform

Media społecznościowe są zaprojektowane tak, by maksymalizować czas spędzony w aplikacji, co faworyzuje treści budzące kontrowersje. CyberTrolling pasożytuje na algorytmach, które promują gniew i strach.

Algorytmy optymalizują zasięgi pod kątem zaangażowania, a nie prawdziwości.

Dezinformacja generuje wyższe zyski z reklam niż stonowana analiza.

Bez zmiany mechanizmów monetyzacji platform, walka z trollingiem będzie tylko leczeniem objawowym.Asymetria kosztów Brandoliniego

Wytworzenie fałszu przy użyciu AI kosztuje ułamki centów, podczas gdy jego rzetelne obalenie wymaga pracy ekspertów i wysokich nakładów. Ta dysproporcja sprawia, że systemy weryfikacji są stale przeciążone.

Produkcja bzdur jest łatwo skalowalna.

Sprostowania docierają do znacznie mniejszej grupy odbiorców niż sensacyjne kłamstwo.

Wymusza to przejście na systemy prewencyjne zamiast reaktywnego prostowania newsów.Zatruwanie danych (Data Poisoning)

CyberTrolling uderza w przyszłość, nasycając internet fałszywymi danymi, na których szkolą się kolejne modele AI. Może to prowadzić do trwałego skrzywienia algorytmów, które będą podawać kłamstwa jako obiektywne fakty.

AI traktuje statystyczną częstotliwość występowania danych jako wskaźnik prawdy.

Sabotaż bazy wiedzy internetu jest operacją o skutkach wieloletnich.

To strategiczne zagrożenie dla rzetelności systemów wspierania decyzji.Dylemat tożsamości i kryptografia

Standardy takie jak C2PA pozwalają certyfikować pochodzenie treści, ale wymagają powszechnej adopcji. Jednocześnie próby eliminacji botów poprzez obowiązkową weryfikację tożsamości (Digital ID) rodzą ryzyko totalnej inwigilacji.

Matematyczny podpis zapewnia autentyczność bez cenzury treści.

Brak anonimowości może uciszyć dysydentów w reżimach autorytarnych.

Wyzwanie polega na ochronie prawdy bez zabijania wolności słowa i prywatności.Problem atrybucji i operacje „fałszywej flagi”

Identyfikacja rzeczywistego mocodawcy ataku w CyberTrollingu jest niezwykle trudna. Agresorzy celowo imitują style pisania innych grup lub korzystają z infrastruktury państw trzecich, by zmylić analityków.

Brak jednoznacznych dowodów sprawstwa utrudnia nakładanie sankcji.

Możliwość skłócenia sojuszników poprzez symulowanie ataku pochodzącego od „przyjaciela”.

Atrybucja (ustalenie kto naprawdę stoi za atakiem) zajmuje miesiące, a szkody wizerunkowe następują w kilka minut.Komercjalizacja manipulacji (Shadow PR)

Dezinformacja stała się produktem rynkowym oferowanym przez wyspecjalizowane agencje Black PR. Usługi CyberTrollingu są kupowane przez korporacje do niszczenia konkurencji lub manipulowania kursami akcji.

Prywatny sektor dopracował techniki manipulacji algorytmami do perfekcji biznesowej.

Wykorzystanie trolli do celów handlowych niszczy zasady uczciwej konkurencji.

To zagrożenie, które przenosi wojnę informacyjną z poziomu państw na poziom każdej firmy.Plusy/Szanse (PL/UE)

Budowa standardów cyfrowych.

UE ma szansę narzucić światu normy etycznego AI i certyfikacji treści.

Odporność regionalna

Doświadczenie Polski z wojną hybrydową tworzy unikalny potencjał ekspertów w zakresie cyberbezpieczeństwa.

Wzrost wartości autentyczności

Treści zweryfikowane i ludzkie zyskają na wartości rynkowej jako „premium”.

Minusy/Ryzyka/Zagrożenia (PL/UE)

Destabilizacja społeczna

Stałe podsycanie konfliktów wewnętrznych przez obce botnety.

Koszty infrastrukturalne

Gigantyczne nakłady na modernizację systemów obronnych i administracyjnych.

Ryzyko cenzury

Pokusa wprowadzania restrykcyjnych praw pod pretekstem walki z dezinformacją.

Wnioski

Wnioski krótkoterminowe

Oznaczanie AI

Natychmiastowe wdrożenie technicznych markerów dla każdej treści wygenerowanej przez algorytmy.

Centra odporności

Tworzenie lokalnych jednostek monitorujących ataki CyberTrollingu na poziomie samorządowym i krajowym.

Wnioski średnioterminowe

Adopcja C2PA

Wymóg stosowania certyfikatów autentyczności w mediach publicznych i komunikacji rządowej.

Reforma algorytmiczna

Presja na platformy social media, by wskaźnik wiarygodności był istotnym elementem pozycjonowania treści.

Wnioski długoterminowe

Edukacja poznawcza

Włączenie higieny cyfrowej do edukacji podstawowej jako umiejętności krytycznej analizy bodźców.

Tożsamość kryptograficzna

Rozwój systemów anonimowego potwierdzania człowieczeństwa (Zero-Knowledge Proofs), by eliminować boty bez ujawniania danych osobowych.

Implikacje

Implikacje dla PL/UE

Polska jako państwo frontowe musi zintegrować działania wywiadu cyfrowego z edukacją społeczną.

Stabilność UE zależy od zdolności do wypracowania wspólnego mechanizmu atrybucji ataków informacyjnych.

Implikacje dla biznesu

Ochrona marki przed CyberTrollingiem staje się elementem zarządzania ryzykiem operacyjnym.

Firmy muszą posiadać procedury „kryzysu syntetycznego” na wypadek uderzenia deepfake’ami w ich akcje lub wizerunek.

Implikacje dla “Kowalskiego”

Konieczność przyjęcia postawy „Zero Trust” wobec sensacyjnych treści w sieci.

Obywatel musi nauczyć się odróżniać treść zweryfikowaną od wiralnego szumu, by nie stać się nieświadomym narzędziem w rękach trolli.

Podsumowanie

Ewolucja w stronę CyberTrollingu zamyka epokę naiwnego korzystania z internetu, zmuszając nas do budowy technicznych i psychologicznych murów ochronnych wokół prawdy obiektywnej.

Co to oznacza?

Oznacza to, że internet stał się polem bitwy, na którym Twoje emocje są wykorzystywane przeciwko Tobie, a jedyną metodą obrony jest sprawdzanie skąd pochodzi informacja, zamiast wierzyć w to, jak bardzo wydaje się ona szokująca.BONUS. Karta Kontrolna (Checklista) dla PR i Bezpieczeństwa

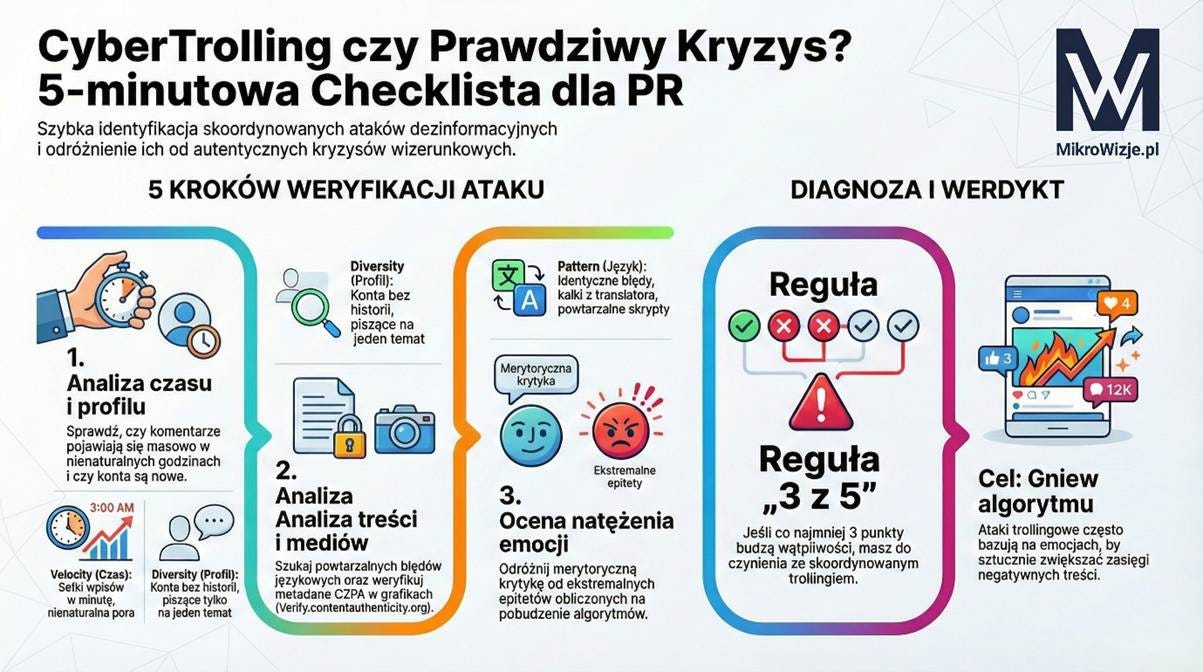

Jak odróżnić CyberTrolling od autentycznego kryzysu w 5 minut?

Analiza czasu (Velocity). Czy negatywne komentarze pojawiły się masowo (setki w minutę) w nienaturalnych godzinach (np. 3:00 rano)?

Analiza profilu (Diversity). Czy konta atakujące mają historię postowania o różnych tematach, czy zostały założone niedawno i piszą tylko o jednym?

Analiza języka (Pattern). Czy komunikaty są identyczne lub zawierają te same rzadkie błędy językowe sugerujące błąd w tłumaczeniu/skrypcie?

Analiza mediów (Origin). Czy grafiki/wideo posiadają metadane C2PA? (Użyj darmowych weryfikatorów online typu Verify.contentauthenticity.org).

Analiza emocji (Sentiment). Czy atak jest merytoryczny, czy opiera się wyłącznie na ekstremalnych epitetach obliczonych na wywołanie gniewu algorytmu?

Jeśli co najmniej 3 punkty budzą wątpliwość to prawdopodobnie masz do czynienia ze skoordynowaną operacją CyberTrollingu.