[NEXTECH]

W dobie hybrydowych zagrożeń i masowej produkcji syntetycznych treści, niezależna weryfikacja ewoluuje z dziennikarstwa w stronę zaawansowanej cyber-detektywistyki.

Szybki wgląd

Demokratyzacja wywiadu. OSINT przełamuje monopol państw na informację, wykorzystując publiczne ślady cyfrowe.

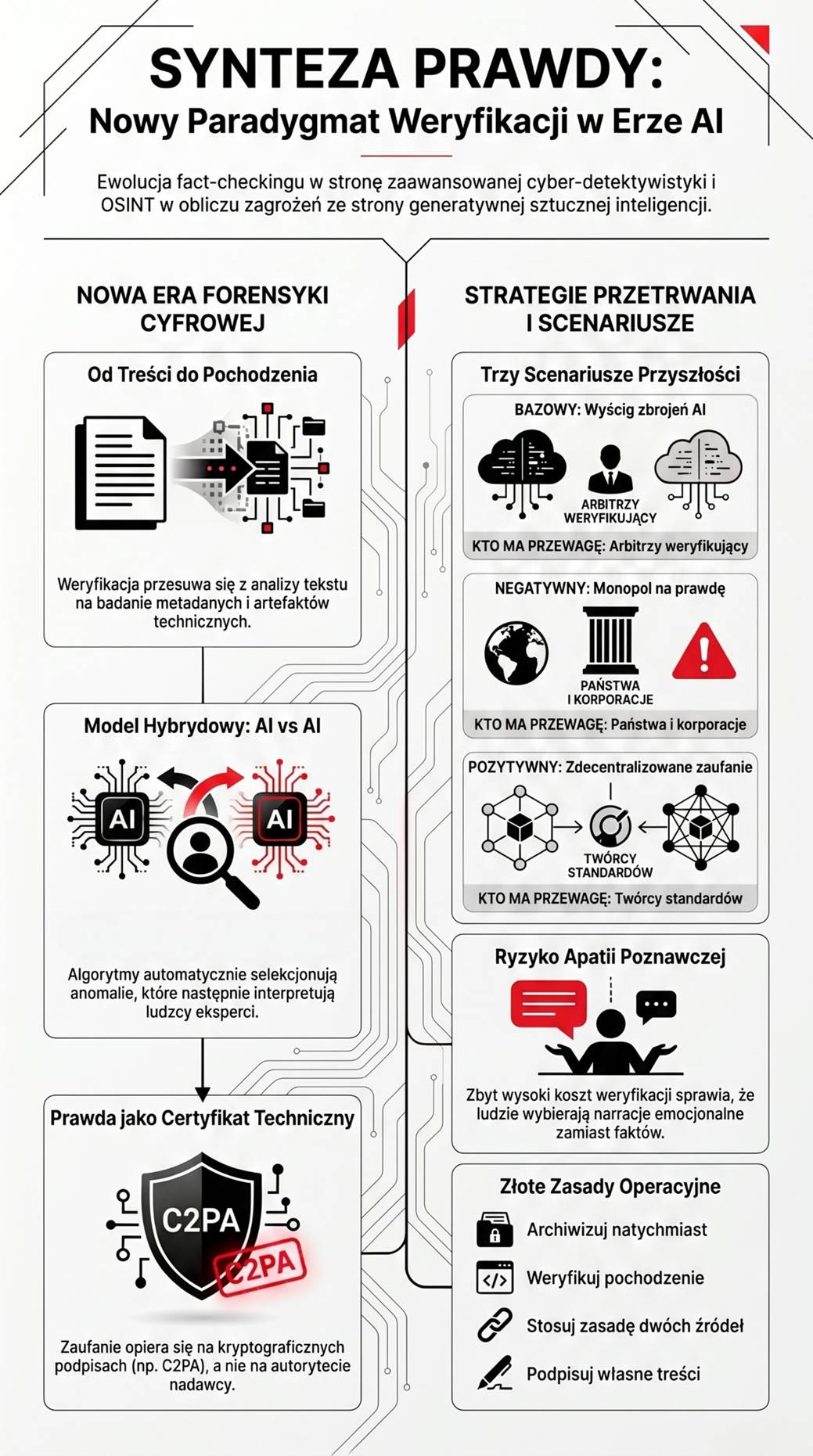

Przesunięcie paradygmatu. Fact-checking zmienia fokus z analizy treści („co powiedziano”) na cyfrową forensykę i pochodzenie („skąd pochodzi sygnał”).

Automatyzacja obrony. Skala dezinformacji wymusza model „AI vs AI”, gdzie algorytmy selekcjonują anomalie dla ludzkich ekspertów.

Radykalna transparentność. Jedyną metodą budowy zaufania jest udostępnienie pełnej ścieżki dowodowej, umożliwiającej replikację śledztwa.

Dlaczego to ma znaczenie teraz?

Tradycyjne metody weryfikacji manualnej stają się zbyt wolne w starciu z generatywną AI, która drastycznie obniża koszt produkcji wiarygodnie wyglądającego kłamstwa. Brak wspólnej bazy faktów paraliżuje procesy demokratyczne i decyzyjne, a „dywidenda kłamcy” pozwala winnym kwestionować autentyczne dowody jako rzekome deepfake’i.

Sygnał

W erze sztucznej inteligencji prawda przestaje być kwestią „wiarygodnego źródła”, a staje się kwestią technicznego certyfikatu.

Co się zmienia?

Dawniej fact-checker czytał tekst i sprawdzał, czy autor kłamie (i nadal tak się dzieje). Dzisiaj coraz częściej śledczy bierze plik pod mikroskop cyfrowy i sprawdza, czy w ogóle stworzył go człowiek.

Kontekst

Organizacje takie jak Bellingcat czy sieci certyfikowane przez IFCN (np. polski Demagog) udowodniły skuteczność OSINT w śledztwach dotyczących zbrodni wojennych i korupcji. Jednocześnie w 2024 roku odnotowano kilkusetprocentowy wzrost liczby deepfake’ów w kampaniach politycznych. W odpowiedzi powstają standardy takie jak C2PA, mające na celu kryptograficzne podpisywanie autentycznych treści cyfrowych.

Analiza

Od weryfikacji treści do śledztwa cyfrowego

Zamiast oceniać wiarygodność przekazu, śledczy analizują artefakty techniczne (metadane, szum cyfrowy, anomalie w cieniowaniu) w celu wykrycia ingerencji AI.

Dlaczego to się dzieje?

Syntetyczna doskonałość: obrazy AI są często zbyt idealne lub zawierają błędy strukturalne niewidoczne dla laika.

Kryzys dowodowy: tradycyjne zdjęcie przestało być dowodem; wymaga teraz „certyfikatu pochodzenia”.

Konsekwencja

Redakcje śledcze stają się laboratoriami technologicznymi, zatrudniającymi analityków danych zamiast klasycznych researcherów.

Synergia hybrydowa: człowiek + automatyzacja

Wykorzystanie algorytmów do monitorowania sieci w czasie rzeczywistym i wyłapywania anomalii, które następnie są interpretowane przez ekspertów.

Dlaczego to się dzieje?

Asymetria kosztów: dezinformacja AI jest masowa i tania; weryfikacja ludzka jest rzadka i droga.

Wykrywanie wzorców: AI bezbłędnie identyfikuje nienaturalną synchronizację kont botów, której człowiek nie dostrzeże w szumie informacyjnym.

Konsekwencja

Rola fact-checkera przesuwa się z „detektywa” na „trenera i nadzorcę” systemów AI, które wykonują pracę wstępną.

Radykalna transparentność jako tarcza

Publikowanie pełnej metodologii, narzędzi i źródeł, co pozwala każdemu odbiorcy na samodzielne powtórzenie procesu weryfikacji.

Dlaczego to się dzieje?

Upadek autorytetów: odbiorcy odrzucają argumenty „z autorytetu” na rzecz twardych dowodów możliwych do sprawdzenia.

Pancerz etyczny: jawna ścieżka dowodowa chroni organizacje przed zarzutami o stronniczość polityczną.

Konsekwencja

Materiały OSINT zyskują status dowodów akceptowanych przez międzynarodowe trybunały (np. MTK w Hadze).

Ryzyka i szanse (PL/UE)

Ryzyka

Weaponizacja fact-checkingu | Tworzenie przez reżimy fałszywych portali „weryfikujących”, które pod pozorami OSINT szerzą propagandę.

Apatia informacyjna | Zalew sprzecznych „faktów” może doprowadzić społeczeństwo do odrzucenia wszelkiej informacji jako niewiarygodnej.

Luki prawne | Brak systemowej ochrony śledczych przed pozwami typu SLAPP, mającymi na celu ich uciszenie.

Błędy OSINT | Ryzyko niesłusznego oskarżenia osób prywatnych przez internetowych amatorów.

Szanse

Suwerenność informacyjna | Budowa europejskich systemów weryfikacji (np. EDMO) niezależnych od platform Big Tech.

Standardy kryptograficzne | Wdrożenie C2PA jako unijnej normy dla administracji i mediów zwiększy odporność na deepfake’i.

Wzrost wartości prawdy | Autorytatywna, ręczna weryfikacja staje się pożądanym towarem premium.

Co dalej? (Scenariusze)

1. Scenariusz bazowy

Weryfikacja stanie się nieustannym wyścigiem zbrojeń między AI generującą fałsz a AI go wykrywającą, z człowiekiem w roli arbitra końcowego.

„Wyścig zbrojeń + człowiek jako ostatnia instancja”

Mechanizm

System stabilizuje się w stanie permanentnej równowagi napięcia:

AI generuje fałsz (syntetyczne treści, deepfake, operacje wpływu),

AI wykrywa fałsz (detekcja anomalii, modele weryfikacyjne),

człowiek pozostaje „sądem ostatniej instancji”. I to nie dlatego, że jest najlepszy, tylko dlatego, że system nie ma lepszego arbitra.

Dynamika

każda nowa generacja modeli generatywnych → chwilowa przewaga fałszu,

każda nowa generacja detekcji → chwilowa stabilizacja,

cykl przyspiesza.

Powstaje permanentny stan niepewności poznawczej.

Apatia poznawcza

Ryzyko: jeśli koszt weryfikacji jest zbyt wysoki, przeciętna jednostka przestaje w ogóle dbać o prawdę i wybiera narrację, która jest najwygodniejsza emocjonalnie. To sprawia, że arbitraż ludzki staje się podatny na błędy wynikające ze zmęczenia.

Punkt przełomu

Moment, w którym:

większość treści online jest nieodróżnialna od syntetycznej,

ale nadal istnieją narzędzia weryfikacyjne dostępne dla elit/organizacji

Jak działa rzeczywistość w tym scenariuszu?

informacja ≠ prawda,

prawda = proces weryfikacji.

Decyzje podejmują ci, którzy mają: narzędzia, procedury oraz czas.

Konsekwencje dla jednostki:

przeciążenie poznawcze,

konieczność filtrowania rzeczywistości,

rosnąca zależność od „zaufanych źródeł”.

Konsekwencje dla biznesu:

wzrost kosztów analizy informacji,

powstanie funkcji „internal verification / CI layer”.

Konsekwencje dla państwa:

walka o dominację w obszarze: detekcji oraz narracji.

Inżynieria konsensusu

Mechanizm: państwo nie musi zakazywać informacji. Wystarczy, że jego algorytmy oznaczą niewygodne fakty jako „niezweryfikowane” lub „wygenerowane przez AI”. W systemie, gdzie koszt samodzielnej weryfikacji jest zaporowy, takie oznaczenie jest równoznaczne z wykasowaniem informacji z obiegu.

Sygnał końcowy

„Prawda nie znika, ale przestaje być dostępna bez kosztu.”

2. Scenariusz negatywny

Koszt weryfikacji przerośnie możliwości niezależnych mediów, pozostawiając monopol na „prawdę” najsilniejszym graczom państwowym i korporacyjnym.

„Monopol na prawdę”

Mechanizm

Koszt weryfikacji rośnie wykładniczo. Potrzeba: infrastruktury AI, danych, mocy obliczeniowej, zespołów analitycznych.

Dlatego tylko najwięksi gracze są w stanie to utrzymać.

Dynamika

upadek niezależnych mediów (brak zdolności weryfikacyjnej),

wzrost znaczenia: platform, państw, korporacji technologicznych.

Powstaje asymetria poznawcza

Punkt przełomu

Moment, w którym:

„prawda” przestaje być weryfikowalna oddolnie,

a zaczyna być deklarowana przez system

Jak działa rzeczywistość?

Nie masz dostępu do procesu weryfikacji.

Masz dostęp do wyniku weryfikacji.

Konsekwencje dla jednostki:

utrata suwerenności poznawczej,

zależność od platform („to jest prawdziwe, bo oznaczone”).

Konsekwencje dla biznesu:

konieczność dostosowania się do standardów platform / regulatorów,

ryzyko „wyłączenia z obiegu informacyjnego”

Konsekwencje dla państwa:

narzędzie kontroli: narracji, reputacji, dostępu do informacji

Efekt systemowy

Powstaje „system kredytu poznawczego” (twoja wiarygodność = dostęp do informacji).

Sygnał końcowy

„Nie chodzi o to, co jest prawdą, tylko kto ma prawo ją definiować.”

3. Scenariusz pozytywny

Powstanie zdecentralizowana sieć weryfikacji oparta na blockchain i podpisach cyfrowych, która trwale przywróci zaufanie do treści w internecie.

„Zdecentralizowane zaufanie”

Mechanizm

Powstaje alternatywny system oparty na: podpisach kryptograficznych, identyfikacji źródła, rejestrowaniu zmian (ledger / blockchain).

Każda informacja ma: pochodzenie, historię, integralność.

Dynamika

rozwój standardów: podpisów treści, identyfikacji AI vs człowiek,

powstawanie zdecentralizowanych sieci weryfikacyjnych.

Powstaje warstwa zaufania ponad internetem

Punkt przełomu

Moment, w którym:

brak podpisu = brak wiarygodności,

podpis = standard komunikacji.

Jak działa rzeczywistość?

Nie pytasz: „czy to prawda?”.

Pytasz: “kto to podpisał i jaka jest historia tej informacji oraz czy była modyfikowana?”.

Konsekwencje dla jednostki:

odzyskanie kontroli nad informacją,

możliwość budowy własnej wiarygodności (tożsamość cyfrowa).

Konsekwencje dla biznesu:

transparentność łańcuchów informacji,

nowe standardy: komunikacji i raportowania.

Konsekwencje dla państwa:

trudniejsza manipulacja systemowa,

ale mniejsza kontrola nad narracją.

Ryzyko (ważne)

To nie jest utopia. System może być: technicznie trudny, elitarny, podatny na obejścia.

Centralizacja zaufania do wystawców kluczy.

Mechanizm: nawet w zdecentralizowanym systemie ktoś musi „podpisać” pierwszy raz. Jeśli hakerzy lub państwa przejmą kontrolę nad źródłowymi kluczami kryptograficznymi, mogą podpisywać fałsz jako „prawdę certyfikowaną”. Zaufanie przesuwa się z treści na „bezpieczeństwo klucza”.

Sygnał końcowy

„Zaufanie przestaje być deklaracją, lecz staje się właściwością technologii.”

4. Konkluzja

Te trzy scenariusze układają się w bardzo czysty wybór strategiczny.

Bazowy → przewagę mają ci, którzy potrafią weryfikować.

Negatywny → przewagę mają ci, którzy kontrolują system.

Pozytywny → przewagę mają ci, którzy budują standardy.

Przyszłość informacji nie rozstrzygnie się w tym, co jest prawdą, ale w tym, kto kontroluje proces jej weryfikacji lub kto potrafi go obejść.

Wnioski operacyjne

Weryfikuj pochodzenie, nie treść. Skup się na tym, skąd pochodzi materiał i czy posiada certyfikowane metadane.

Archiwizuj natychmiast. Korzystaj z narzędzi takich jak Wayback Machine lub Archive.today, zanim manipulowana treść zostanie usunięta lub zmieniona.

Wprowadź analitykę śledczą. Wdróż weryfikację wizualną (np. InVID/WeVerify) do analizy artefaktów w obrazach i wideo.

Wprowadź zasadę “dwóch źródeł”. Nigdy nie opieraj decyzji na jednej informacji, zwłaszcza jeśli wywołuje silne emocje.

Podpisuj własne treści. Stosuj standardy kryptograficzne, aby chronić markę przed podszywaniem się (spoofing).

Inwestuj w kompetencje danych. Analiza SQL/Python staje się ważniejsza niż warsztat pisarski w nowoczesnym wywiadzie obywatelskim.

Implikacje

Dla PL/UE

Konieczność budowy autonomicznych zdolności wykrywania operacji wpływów, które łączą analizę techniczną AI z kontekstem lokalnym (lingwistycznym i kulturowym).

Dla biznesu

Zagrożenie atakami na reputację (deepfake CEO, fałszywe raporty finansowe) wymaga posiadania procedur natychmiastowej weryfikacji technicznej.

Dla jednostki/obywatela

Konieczność przejścia na model „ograniczonego zaufania” i rozwoju umiejętności korzystania z podstawowych narzędzi OSINT.

Podsumowanie

Współczesny fact-checking to proces technologiczny, w którym AI jest jednocześnie największym zagrożeniem i niezbędnym narzędziem. Kluczem do przetrwania wiarygodnej informacji jest przejście od wiary w markę nadawcy do technicznej weryfikowalności pochodzenia danych.

Weryfikacja faktów ewoluuje w stronę hybrydowego wywiadu technicznego, gdzie analiza pochodzenia (provenance) i transparentność metody stanowią jedyną skuteczną barierę przed masową dezinformacją wspieraną przez AI.