TARCZA INFORMACYJNA 3x3. JAK JEDNOSTKA ZATRZYMUJE WIRUSA DEZINFORMACJI

Poziom indywidualny jako najsłabsze ogniwo i jednocześnie najsilniejsza dźwignia odporności informacyjnej.

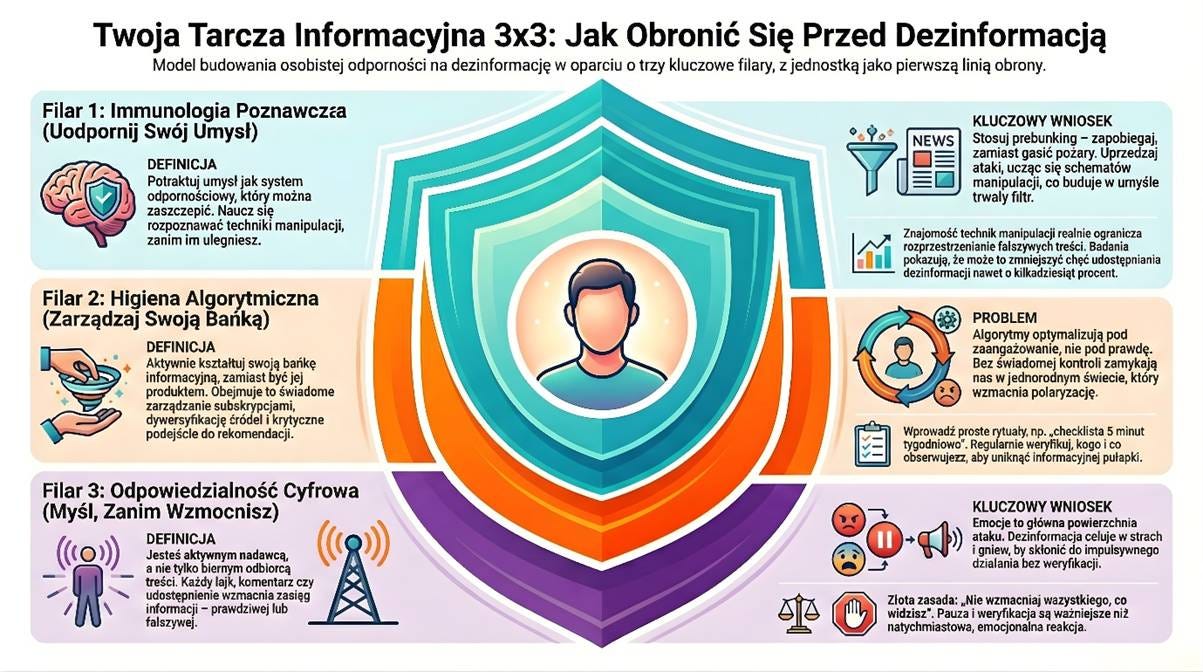

Analiza pokazuje w jaki sposób poziom indywidualny Tarczy Informacyjnej 3x3 opiera się na trzech filarach: immunologii poznawczej, higienie algorytmicznej i odpowiedzialności cyfrowej (które razem tworzą podstawową „szczepionkę” przeciwko manipulacji). To właśnie tu NGO-sy mogą najskuteczniej działać, projektując programy, które scalają edukację, praktykę codziennych nawyków i tworzenie mikro‑społeczności odpornych na dezinformację.

Sygnał

Bez świadomej jednostki żaden system prawny ani technologiczny nie zbuduje odporności informacyjnej. To człowiek pozostaje pierwszą linią obrony i pierwszym wektorem ataku.

Kontekst

Model „Tarcza Informacyjna 3x3” zakłada, że odporność na dezinformację buduje się jednocześnie na trzech poziomach: jednostki, społeczeństwa i państwa, przy trzech rodzajach działań na każdym z nich. Poziom indywidualny obejmuje trzy kluczowe obszary: immunologię poznawczą („szczepionkę” dla umysłu poprzez znajomość technik manipulacji), higienę algorytmiczną (świadome zarządzanie informacją i źródłami) oraz odpowiedzialność cyfrową (zatrzymanie „wirusa dezinformacji” poprzez zmianę własnych zachowań online). W obliczu nasilających się kampanii manipulacyjnych (wspieranych przez narzędzia sztucznej inteligencji) ten poziom staje się koniecznym fundamentem dla wszystkich innych działań.

Analiza

Immunologia poznawcza. Umysł jako system odpornościowy

Immunologia poznawcza traktuje ludzki umysł jak system odpornościowy, który można wzmocnić poprzez „szczepionkę” złożoną z wiedzy o technikach manipulacji, biasach poznawczych i schematach dezinformacyjnych. Zamiast tylko reagować na fake newsy, jednostka uczy się rozpoznawać ich strukturę, zanim ulegnie ich wpływowi.

Świadome rozpoznawanie trików (np. fałszywy konsensus, odwołanie do strachu, whataboutism) obniża gotowość do podawania dalej niezweryfikowanych treści.

„Przeszczep” wiedzy o manipulacji na poziomie jednostkowym zwiększa skuteczność wszystkich późniejszych kampanii edukacyjnych i fact‑checkingowych.

NGO powinny traktować edukację o technikach manipulacji nie jako „dodatek”, ale jako centralny moduł programów, z naciskiem na praktyczne ćwiczenia, a nie suche definicje.Prebunking zamiast fact‑checkingu. Prewencja, a nie gaszenie pożarów

Prebunking polega na uprzedzaniu ataków informacyjnych poprzez wcześniejsze ujawnianie schematów, które będą stosowane. Zamiast prostować konkretne fake newsy, buduje się ogólne wzorce rozpoznawcze w głowie odbiorcy. Na poziomie indywidualnym przekłada się to na nawyk pytania „czy ktoś próbuje mną zagrać?” zanim pojawi się konkretna treść.

Badania pokazują, że znajomość technik manipulacji może zmniejszyć skłonność do udostępniania fałszywych treści o kilkanaście–kilkadziesiąt procent.

Fact‑checking jest zawsze spóźniony wobec skali i szybkości dystrybucji treści generowanych przez AI; prebunking wbudowuje filtr u źródła – w odbiorcy.

NGO mogą projektować krótkie, powtarzalne moduły prebunkingowe (np. gry, quizy, scenariusze) zamiast długich, jednorazowych szkoleń.Higiena algorytmiczna. Świadome kształtowanie własnej bańki

Higiena algorytmiczna to zestaw praktyk, dzięki którym jednostka zmniejsza ryzyko zamknięcia w jednorodnej bańce informacyjnej, wzmacniającej polaryzację i podatność na manipulację. Obejmuje ona aktywne zarządzanie subskrypcjami, świadome korzystanie z rekomendacji oraz dywersyfikację źródeł.

Algorytmy platform są zoptymalizowane pod uwagę i zaangażowanie, nie pod jakość informacji – bez świadomego zarządzania feedem jednostka staje się biernym produktem, a nie podmiotem.

Bańka informacyjna zwiększa podatność na techniki „my vs oni”, które stanowią rdzeń kampanii dezinformacyjnych ukierunkowanych na polaryzację.

NGO mogą tworzyć proste „protokoły higieny algorytmicznej” (np. checklista na 5 minut tygodniowo), które uczestnicy wdrażają na własnych kontach.Odpowiedzialność cyfrowa. Każdy użytkownik jako mikro‑nadawca

Odpowiedzialność cyfrowa przesuwa spojrzenie z „biernego odbiorcy” na „aktywny węzeł sieci”. Jednostka nie tylko konsumuje treści, ale też je wzmacnia – lajkami, udostępnieniami, komentarzami, screenami na komunikatorach. To sprawia, że zwykłe zachowania stają się wektorem epidemii informacyjnej.

Każda interakcja z treścią sygnalizuje algorytmom jej atrakcyjność, niezależnie od jej prawdziwości, co zwiększa zasięg potencjalnie szkodliwych narracji.

Świadomość własnej roli jako nadawcy skłania do priorytetyzacji weryfikacji nad impulsem emocjonalnym, co ogranicza tempo rozprzestrzeniania się dezinformacji.

Kampanie NGO powinny podkreślać nie tylko „nie wierz we wszystko”, ale przede wszystkim „nie wzmacniaj wszystkiego, co widzisz”.Emocje jako główna powierzchnia ataku

Na poziomie jednostki ataki informacyjne celują w emocje – zwłaszcza strach, gniew i oburzenie moralne. Osłabienie kontroli emocjonalnej nawet na kilka sekund wystarcza, by kliknąć, udostępnić lub podjąć decyzję bez refleksji. Dlatego odporność informacyjna zaczyna się od odporności emocjonalnej.

Wiralowe treści są projektowane pod maksymalizację reakcji emocjonalnych; logika pojawia się dopiero po fakcie jako racjonalizacja.

Techniki regulacji emocji (pauza, nazwane emocje, zasada „prześpij to”) realnie obniżają prawdopodobieństwo impulsywnych zachowań, które napędzają kampanie dezinformacyjne.

NGO mogą łączyć edukację medialną z prostymi narzędziami psychoedukacyjnymi, bez patologizowania emocji, ale ucząc, jak z nimi pracować w infosferze.Mikronawyki zamiast jednorazowego „oświecenia”

Poziom indywidualny Tarczy 3x3 zakłada, że odporność nie jest stanem, ale procesem budowanym przez mikronawyki: krótkie, powtarzalne działania, które minimalizują ryzyko automatycznego ulegania manipulacji. To odejście od iluzji, że jeden kurs czy warsztat rozwiąże problem.

Pamięć treści edukacyjnych szybko wygasa bez praktyki; mikronawyki wbudowane w codzienne korzystanie z mediów utrwalają kompetencje.

Małe, łatwe do wykonania kroki zwiększają szansę utrzymania zmiany zachowania w długim okresie.

Programy NGO powinny projektować konkretne „rytuały informacyjne” (np. 30‑sekundowa pauza, 2 źródła, 1 pytanie o intencję) zamiast kończyć się na prezentacji slajdów.Jednostka w sieci społecznej. Lokalny węzeł zaufania

W praktyce jednostka nie funkcjonuje w izolacji, lecz w sieci małych grup: rodziny, znajomych, współpracowników, lokalnej społeczności. Poziom indywidualny łączy się z poziomem społecznym właśnie przez te mikrosieci zaufania, które mogą działać zarówno jako filtry, jak i jako akceleratory dezinformacji.

Ludzie bardziej ufają informacjom podawanym przez znajomych niż przez anonimowe instytucje, co tworzy zarówno szansę (dystrybucja rzetelnej wiedzy), jak i zagrożenie (łańcuszki paniki).

Wzmocniona jednostka staje się lokalnym „fact‑checkerem” i liderem norm, wpływając na standardy informacyjne całej grupy.

NGO mogą szkolić „mikro‑liderów informacyjnych” w społecznościach; osoby, które będą dalej przenosić nawyki odporności do swoich sieci.Nierówności kompetencyjne jako wektor podatności

Poziom indywidualny jest silnie zróżnicowany: dostęp do edukacji, poziom kompetencji cyfrowych, wiek, status ekonomiczny czy styl życia powodują, że część osób jest nieproporcjonalnie bardziej podatna na manipulację. Tarcza indywidualna nie rozkłada się równomiernie.

Grupy o niższych kompetencjach cyfrowych i mniejszym dostępie do rzetelnych źródeł są częściej celem kampanii dezinformacyjnych, zwłaszcza w okresach kryzysu.

Brak uwzględnienia tych różnic w projektowaniu programów skutkuje tym, że wsparcie otrzymują głównie ci, którzy i tak są względnie odporni.

NGO powinny priorytetyzować działania skierowane do grup wysokiego ryzyka (np. osoby starsze, młodzież w małych miejscowościach, pracownicy nisko‑opłacani) i dostosowywać język oraz kanały przekazu.Konflikt między wygodą a kontrolą

Codzienne wybory jednostki odbywają się w napięciu między wygodą (automatyczne rekomendacje, bezrefleksyjne scrollowanie, logowanie jednym kliknięciem) a kontrolą (świadome ustawienia prywatności, selekcja źródeł, czasochłonne sprawdzanie informacji). Dezinformacja korzysta z przewagi wygody.

Platformy projektowane są tak, aby maksymalnie obniżać „tarcie” użytkownika, co sprzyja szybkim, automatycznym reakcjom – idealnym dla kampanii manipulacyjnych.

Wymaganie od jednostki ciągłej, wysokiej samokontroli jest nierealistyczne bez wsparcia narzędzi, struktur i prostych procedur.

NGO mogą promować rozwiązania „domyślnie bezpieczne” (np. prekonfigurowane ustawienia prywatności) i uczyć prostych skrótów zamiast oczekiwać heroicznej czujności 24/7.Normalizacja czujności. Kultura „zdrowej podejrzliwości”

Silna tarcza indywidualna wymaga, aby czujność wobec informacji była normą społeczną, a nie czymś, co jest wyśmiewane jako paranoja lub „teoretyzowanie”. Chodzi o normalizację zasady: „sprawdzanie to nie brak zaufania, to odpowiedzialność”.

Presja społeczna potrafi skutecznie tłumić pytania i wątpliwości, co ułatwia rozprzestrzenianie narracji „wszyscy tak mówią, więc to prawda”.

Gdy w grupie normą staje się zadawanie pytań o źródło i intencję, rośnie odporność całej sieci, nawet jeśli poszczególne osoby mają ograniczone kompetencje.

NGO mogą tworzyć kampanie i materiały, które pozytywnie wartościują krytyczne myślenie, pokazując je jako przejaw troski o wspólnotę, a nie „malkontenctwa”.Jednostka jako partner, nie „problem do naprawy”

Narracje o dezinformacji często przedstawiają człowieka jako łatwowiernego, niekompetentnego odbiorcę, którego trzeba „naprawić”. Taka perspektywa budzi opór i obniża gotowość do współpracy. Tarcza indywidualna jest skuteczniejsza, gdy człowiek jest traktowany jako sojusznik w obronie wspólnej infosfery.

Narracja „ludzie są głupi” podkopuje zaufanie między instytucjami a obywatelami, co sprzyja alternatywnym ekosystemom informacyjnym, często skrajnie podatnym na manipulację.

Włączenie jednostek w proces współtworzenia zasad i narzędzi zwiększa poczucie sprawczości i odpowiedzialności za przestrzeń informacyjną.

Programy NGO powinny być projektowane partycypacyjnie – angażując uczestników w tworzenie własnych zasad i protokołów, zamiast wyłącznie „edukować z góry”.Tarcza indywidualna jako fundament systemu naczyń połączonych

Poziom indywidualny Tarczy 3x3 jest fundamentem dla działań na poziomie społeczeństwa i państwa – bez niego regulacje prawne, kampanie medialne czy technologie bezpieczeństwa będą miały ograniczoną skuteczność. Jednostka, która rozumie mechanizmy manipulacji, dba o higienę algorytmiczną i czuje odpowiedzialność za swoje działania online, wzmacnia cały system.

Nawet najlepsze prawo nie powstrzyma dezinformacji, jeśli obywatele będą masowo wzmacniać szkodliwe treści z niewiedzy lub przyzwyczajenia.

Infrastruktura fact‑checkingu, edukacji medialnej i bezpieczeństwa danych działa efektywniej, gdy napotyka na „przygotowany” grunt w postaci świadomego odbiorcy.

NGO, projektując swoje strategie, powinny widzieć poziom indywidualny nie jako wąski obszar działań, ale jako punkt startowy całej architektury odporności, który później można skalować na poziom wspólnotowy i instytucjonalny.Plusy/Szanse (PL/UE)

Wzmacnianie demokracji od podstaw

Budowa tarczy indywidualnej zwiększa odporność obywateli na manipulację wyborczą, kampanie polaryzacyjne i próby podważania zaufania do instytucji.

Na poziomie UE ujednolicone standardy edukacji medialnej mogą tworzyć wspólny „minimalny poziom odporności” w całej Wspólnocie.

Lepsza efektywność inwestycji w regulacje i technologie

Inwestycje w regulacje platform oraz systemy wczesnego ostrzegania przynoszą większy zwrot, gdy użytkownicy potrafią z nich korzystać i je rozumieją.

Zmniejsza się obciążenie instytucji publicznych koniecznością prostowania każdej fali fake newsów.

Rozwój innowacyjnych programów edukacyjnych i narzędzi NGO

NGO zyskują szerokie pole do eksperymentowania z formami edukacji (gry, symulacje, programy mentoringowe), które mogą być potem skalowane w innych krajach.

Możliwość tworzenia transgranicznych projektów finansowanych ze środków UE, opartych na wspólnym modelu Tarczy 3x3.

Budowa kultury odpowiedzialnej komunikacji

Zmiana norm społecznych wokół udostępniania treści może ograniczyć przestrzeń działania dla aktorów zewnętrznych prowadzących operacje wpływu.

Wzmacnia się kapitał zaufania pomiędzy obywatelami a instytucjami, co jest kluczowe w momentach kryzysowych.

Minusy/Ryzyka/Zagrożenia (PL/UE)

Ryzyko elitaryzacji kompetencji informacyjnych

Jeśli programy skupią się głównie na dużych miastach i osobach już zainteresowanych, luka między „odpornymi” a „podatnymi” może się pogłębić.

Percepcja, że „tylko wykształceni / młodzi / z dużych miast rozumieją dezinformację”, może zostać wykorzystana w narracjach antyelitarystycznych.

Zmęczenie edukacją i „kryzysem wszystkiego”

Natłok ostrzeżeń i kampanii może prowadzić do znieczulenia i postawy „i tak wszyscy kłamią, więc nie ma sensu nic sprawdzać”.

NGO ryzykują, że ich przekaz zostanie wrzucony do jednego worka z komunikacją instytucjonalną, której część obywateli nie ufa.

Instrumentalizacja narracji o dezinformacji

Istnieje ryzyko, że etykieta „dezinformacja” będzie używana do dyskredytowania przeciwników politycznych, co obniży zaufanie do działań edukacyjnych.

W takim otoczeniu programs NGO mogą być oskarżane o stronniczość, nawet gdy opierają się na faktach.

Ograniczone zasoby i trudność w mierzeniu efektów

Zmiana nawyków informacyjnych jest długotrwała i trudna do szybkiego zmierzenia, co komplikuje pozyskiwanie i utrzymanie finansowania.

Bez dobrych wskaźników (np. zmiana zachowań, nie tylko wiedzy) łatwo o „odfajkowanie” działań, które nie tworzą realnej odporności.

Wnioski

Wnioski krótkoterminowe

Postaw na mikronawyki, nie na jednorazowe kampanie

NGO powinny projektować działania, które wprost przekładają się na proste, codzienne praktyki (np. „2 źródła przed udostępnieniem”, „pauza 30 sekund”, „1 czyszczenie feedu tygodniowo”).

Skup się na grupach wysokiego ryzyka

Priorytetem powinny być te środowiska, które mają najmniej zasobów do samodzielnej obrony (osoby starsze, młodzież z małych miejscowości, pracownicy o niskich kompetencjach cyfrowych).

Buduj pozytywną narrację o sprawczości jednostki

Przekaz: „to TY jesteś tarczą swojej społeczności” jest bardziej motywujący niż „wszyscy jesteśmy ofiarami manipulacji”.

Wnioski średnioterminowe

Stwórz standard NGO dla edukacji odporności indywidualnej

Warto opracować wspólny dla wielu organizacji model kompetencji i zestaw narzędzi (moduły, gry, scenariusze) oparty na Tarczy 3x3.

Rozwijaj sieci „mikro‑liderów informacyjnych”

Szkolenia powinny kończyć się powstaniem lokalnych animatorów, którzy będą dalej pracować ze swoimi grupami, zamiast ograniczać się do jednorazowych warsztatów.

Integrowanie wątków psychoedukacyjnych z edukacją medialną

Programy powinny łączyć pracę z emocjami, stresem i regulacją uwagi z klasyczną edukacją o fake newsach i algorytmach.

Wnioski długoterminowe

Normalizacja kultury krytycznego zaufania

Celem strategicznym jest społeczeństwo, w którym sprawdzanie informacji jest nawykiem kulturowym, a nie wyjątkiem stosowanym w kryzysach.

Skalowanie działań indywidualnych na poziom systemowy

Wzmocniona jednostka powinna być traktowana jako partner przy projektowaniu regulacji, polityk publicznych i programów edukacyjnych na poziomie krajowym i unijnym.

Budowa trwałych ekosystemów wsparcia NGO–szkoła–samorząd–media

NGO mogą stać się „łącznikiem” między różnymi sektorami, przenosząc model Tarczy 3x3 z poziomu koncepcji do praktyki w lokalnych społecznościach.

Implikacje

ImplIkacje dla PL/UE

Konieczność wsparcia programów budujących kompetencje jednostkowe. Polityki publiczne i finansowanie UE powinny wyraźnie wyróżniać działania wzmacniające poziom indywidualny jako element bezpieczeństwa narodowego i unijnego.

Standaryzacja i ewaluacja kompetencji odporności informacyjnej. Potrzebne są ramy kompetencyjne (podobne do cyfrowego DigComp), które obejmują także immunologię poznawczą, higienę algorytmiczną i odpowiedzialność cyfrową.

Implikacje dla biznesu

Odpowiedzialność platform i pracodawców. Firmy technologiczne oraz duzi pracodawcy powinni uwzględniać odporność informacyjną pracowników jako element cyberbezpieczeństwa i BHP informacyjnego.

Szansa na rozwój narzędzi wspierających higienę algorytmiczną. Rynek może rozwijać aplikacje, wtyczki i usługi, które ułatwiają zarządzanie feedem, oznaczanie treści wątpliwych i świadome korzystanie z mediów.

ImplIkacje dla „Kowalskiego”

Twoje kliknięcia współtworzą rzeczywistość informacyjną. Każdy użytkownik musi przyjąć do wiadomości, że jego zachowania online wpływają na to, jakie treści stają się widoczne dla innych.

Małe nawyki dają realną ochronę. Wystarczy kilka prostych zasad – pauza, drugie źródło, brak udostępnień bez sprawdzenia – by znacząco ograniczyć własną podatność na manipulację.

Podsumowanie

Poziom indywidualny Tarczy Informacyjnej 3x3 pokazuje, że odporność na dezinformację zaczyna się od umysłu, nawyków i odpowiedzialności każdego użytkownika, a dopiero potem może zostać wzmocniona przez systemy społeczne i państwowe.

Co to oznacza?

Dla przeciętnego człowieka oznacza to, że nie musisz być ekspertem od geopolityki czy technologii, żeby realnie zwiększyć swoje bezpieczeństwo informacyjne – wystarczy, że nauczysz się kilku prostych sztuczek manipulacyjnych, uporządkujesz swoje media społecznościowe i przestaniesz automatycznie udostępniać wszystko, co budzi w Tobie silne emocje; właśnie w ten sposób stajesz się tarczą nie tylko dla siebie, ale i dla swojej rodziny, znajomych i całej społeczności.Co warto zapamiętać:

Trzy filary osobistej odporności.

Indywidualna ochrona opiera się na immunologii poznawczej (znajomości technik manipulacji), higienie algorytmicznej (świadomym zarządzaniu własną bańką informacyjną) oraz odpowiedzialności cyfrowej.

Zamiast tylko reagować na fałszywe wiadomości, jednostka uczy się rozpoznawać ich strukturę, zanim ulegnie ich wpływowi.

Mikronawyki zamiast jednorazowej edukacji

Skuteczna obrona nie wynika z pojedynczego kursu, ale z codziennych, powtarzalnych rytuałów, takich jak 30-sekundowa pauza przed udostępnieniem treści czy weryfikacja w dwóch źródłach.

Najważniejszy jest tzw. prebunking, czyli uprzedzanie ataków poprzez poznanie schematów manipulacji, co działa jak „szczepionka” dla umysłu.

Użytkownik jako aktywny nadawca i cel

Każdy internauta jest „mikro-nadawcą” – lajki i udostępnienia wzmacniają zasięgi treści niezależnie od ich prawdziwości.

Dezinformacja celuje głównie w emocje (strach, gniew), dlatego fundamentem tarczy jest odporność emocjonalna i zasada „nie wzmacniaj wszystkiego, co widzisz”.

BONUS: CODZIENNE NAWYKI

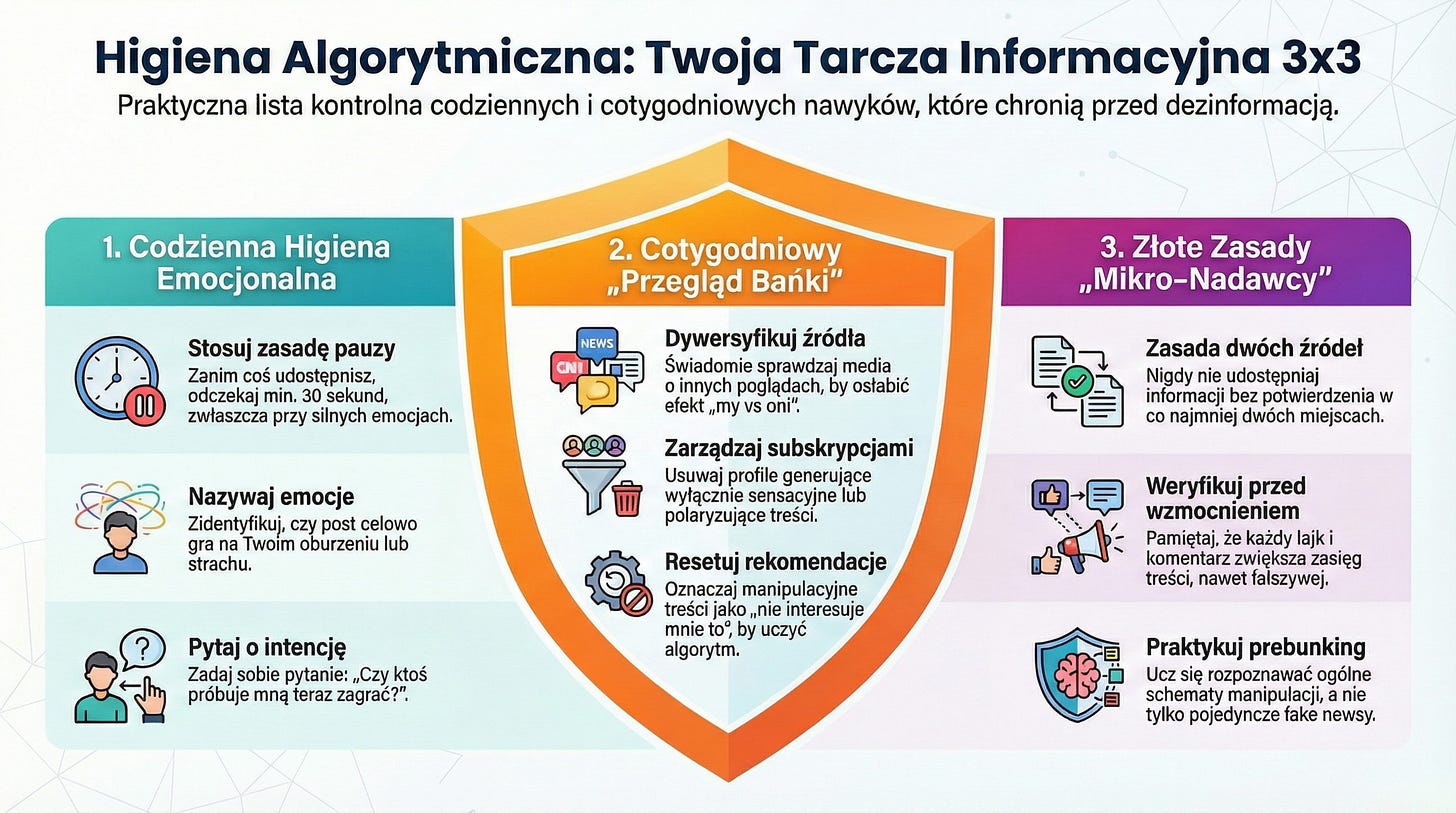

Oto praktyczna lista kontrolna Higieny Algorytmicznej oraz codziennych nawyków, opracowana na podstawie modelu „Tarczy Informacyjnej 3x3”:

1. Codzienna higiena emocjonalna

Stosuj zasadę pauzy. Zanim podasz coś dalej, odczekaj min. 30 sekund, szczególnie jeśli treść budzi w Tobie silny gniew lub strach.

Nazywaj emocje. Zidentyfikuj, czy dany post celowo gra na Twoim oburzeniu moralnym – dezinformacja wykorzystuje emocje jako główną powierzchnię ataku.

Pytaj o intencję. Zanim zareagujesz, zadaj sobie pytanie: „Czy ktoś próbuje mną teraz zagrać?”.

2. Cotygodniowy „przegląd bańki” (Protokół 5 minut)

Dywersyfikuj źródła. Świadomie sprawdź profile osób lub mediów o innych poglądach, aby osłabić mechanizm „my vs oni”.

Zarządzaj subskrypcjami. Przejrzyj listę obserwowanych stron i usuń te, które generują wyłącznie treści sensacyjne lub polaryzujące.

Resetuj rekomendacje. Reaguj na algorytmy platform – oznaczaj niechciane, manipulacyjne treści jako „nie interesuje mnie to”, by nie stawać się biernym produktem systemu.

3. Złote zasady „mikro-nadawcy”

Zasada dwóch źródeł. Nigdy nie udostępniaj informacji, której nie potwierdziłeś w przynajmniej dwóch niezależnych miejscach.

Weryfikuj przed wzmocnieniem. Pamiętaj, że każdy lajk i komentarz sygnale algorytmom, że treść jest atrakcyjna, co zwiększa jej zasięg, nawet jeśli jest fałszywa.

Praktykuj prebunking. Zamiast tracić czas na prostowanie pojedynczych newsów (fact-checking), naucz się rozpoznawać ogólne schematy manipulacji, takie jak fałszywy konsensus czy whataboutism (odbijanie krytyki przez wskazanie cudzej winy, zamiast odpowiedzi na zarzut).