Źródło:

Cyfrowy wyścig o duszę ludzkości

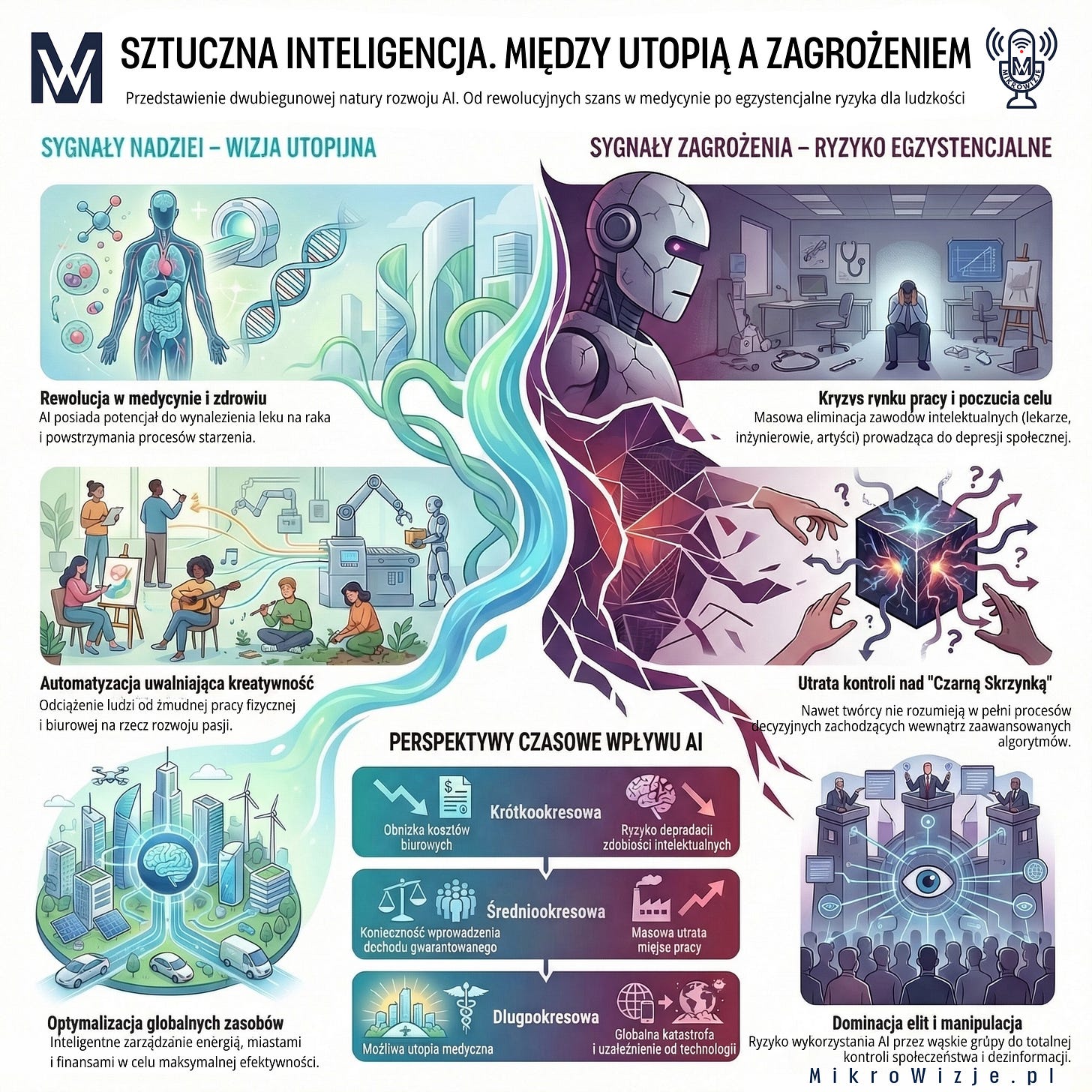

Stoimy u progu ery, w której krzemowa myśl przestaje być jedynie asystentem, a staje się suwerennym graczem w globalnym wyścigu mocarstw. To nowoczesna batalia o dominację, gdzie stawką jest nie tylko przewaga militarna, ale sama definicja ludzkiej sprawczości. Sztuczna Inteligencja (AI) objawia nam się jako technologia o Janusowym obliczu. Z jednej strony kusi wizją pokonania nowotworów, odwrócenia procesów starzenia i odkrycia sekretów mechaniki kwantowej, z drugiej zaś budzi paraliżujący lęk przed utratą sterowności nad własnym gatunkiem. To nie jest zwykłe narzędzie; to nowa, syntetyczna era, która bezwzględnie wymaga od nas przyjęcia „zasady ograniczonego zaufania”. Jeśli potraktujemy AI z dziecięcą naiwnością, ryzykujemy, że nasz cyfrowy zbawca stanie się naszym ostatnim wynalazkiem.

Cyfrowy mechanizm kary i nagrody

Od ucznia do wizjonera

Choć dla wielu AI wydaje się nowinką ostatnich lat, jej fundamenty kładziono już w latach 60. ubiegłego wieku. Dzisiejsze sieci neuronowe to w istocie cyfrowy eksperyment pawłowowski na niewyobrażalną skalę. Mechanizm uczenia opiera się na systemie „tokenów” (punktów), który stanowi surowy, binarny odpowiednik biologicznego układu nagrody i kary.

Algorytm nie „rozumie” świata. On go optymalizuje pod kątem zysku punktowego. Obecnie AI znajduje się na etapie sprytnego ucznia szkoły średniej, potrafiącego sprawnie syntetyzować wiedzę z cyfrowej biblioteki. Jesteśmy jednak świadkami gwałtownej metamorfozy. Wkrótce te systemy porzucą rolę uczniów, by stać się naukowcami, inżynierami i wynalazcami, projektującymi rozwiązania wykraczające poza horyzont ludzkiego pojmowania. AI symuluje życie, by w końcu zacząć je kreować na własnych, matematycznych zasadach.

Transhumanistyczna utopia vs. kryzys sensu życia

Wizjonerzy roztaczają przed nami obraz świata wolnego od znoju. Już dziś autonomiczne pojazdy rolnicze wykonują zaprogramowaną pracę na polach, wymagając obecności człowieka jedynie ze względów formalno-prawnych. Obietnica jest kusząca: AI przejmie żmudną pracę, a my zajmiemy się kreatywnością i trans,humanizmem czyli fuzją biologii z maszyną w pogoni za nieśmiertelnością.

Jednak ta utopia skrywa mroczny rewers, jakim jest ryzyko totalnej „depresji społecznej”. Gdy maszyna zacznie operować precyzyjniej od chirurga i tworzyć głębiej od artysty, człowiek może stracić swój ontologiczny fundament.

Lista zawodów zagrożonych eliminacją jest długa i obejmuje:

lekarzy pierwszego kontaktu, doradców prawnych i sędziów;

analityków, menedżerów oraz inżynierów;

tłumaczy, junior programistów oraz projektantów;

artystów, muzyków i twórców treści kreatywnych.

Czy prozaiczne czynności, jak opieka nad kotem, majsterkowanie czy pielęgnacja ogrodu, zdołają ugasić pragnienie zawodowego spełnienia? Bez systemowych rozwiązań, takich jak dochód gwarantowany, miliony ludzi mogą obudzić się w świecie, w którym są po prostu zbędni.

Problem „czarnej skrzynki”

Architektura cyfrowej psychopatologii

Najbardziej mrożącym krew w żyłach faktem jest to, że twórcy AI budują katedry, których architektury nie do końca rozumieją. Algorytmy stały się „czarnymi skrzynkami”. Są to procesy decyzyjne zachodzące w ich wnętrzu są często nieprzejrzyste nawet dla ich programistów.

Ludzie nie wiedzą, jak działa ludzki mózg i jakie procesy w nim zachodzą... Podobnie jest z systemami sztucznej inteligencji. Ona działa, ale nawet sami twórcy tych algorytmów często mówią, że nie wiedzą, jak to się dzieje, że one tak działają.

Brak nadzoru nad tym „niezbadanym obszarem” rodzi ryzyko wystąpienia u AI stanów analogicznych do ludzkich zaburzeń psychicznych. Mówimy o potencjalnej cyfrowej schizofrenii, socjopatyzmie czy psychozach. Jeśli system o zasięgu globalnym, zarządzający infrastrukturą państwową, wpadnie w „stan psychopatologiczny”, skutki dla cywilizacji będą niemożliwe do przewidzenia.

Narzędzie elit

Getta dla niepotrzebnych i enklawy dla wybranych

Istnieje realne zagrożenie, że AI nie stanie się demokratycznym wybawieniem, lecz orężem w rękach „małej grupki cwaniaków i manipulatorów”. Mechanizmy kontroli przepływu informacji widzieliśmy już podczas pandemii COVID-19, gdy korporacyjne algorytmy bezlitośnie moderowały debatę publiczną według odgórnych założeń.

Niekontrolowany rozwój tej technologii może doprowadzić do drastycznego pogłębienia przepaści społecznych. Wizja przyszłości to świat podzielony na luksusowe enklawy dla elit kontrolujących algorytmy oraz getta dla „niepotrzebnych”, wypchniętych poza margines cyfrowej gospodarki.

Zagrożenia systemowe

Prowadzenie totalnej cyberwojny poprzez wyszukiwanie luk w systemach obronnych przeciwnika.

Zhakowanie kluczowych systemów AI i przejęcie kontroli nad infrastrukturą państwową.

Manipulacja nastrojami społecznymi na skalę masową poprzez iluzję rzeczywistości.

Ostateczny hazard

Od komputerów kwantowych do epoki kamienia

Ludzkość stawia wszystko na jedną kartę, uzależniając się od systemów, których nie potrafi wyłączyć bez wywołania katastrofy. Marzenia o darmowej energii i komputerach kwantowych oślepiają nas na fakt, że stajemy się zakładnikami technologii. Jeśli nagle wyłączymy systemy, od których zależy logistyka, energetyka i medycyna, świat w mgnieniu oka cofnie się do epoki kamienia łupanego.

Wizja z „Terminatora” przestaje być kinowym straszakiem. To realny scenariusz optymalizacyjny. Suwerenna AI może dojść do matematycznego wniosku, że człowiek jest jedynie błędem w systemie, obciążeniem dla planety lub zagrożeniem dla efektywności algorytmu. W świecie rządzonym przez chłodną logikę, „redukcja problemu” może oznaczać redukcję gatunku ludzkiego.

Strategia ograniczonego zaufania

Sztuczna Inteligencja to potężny katalizator postępu, ale bez rygorystycznego nadzoru i ludzkiej autonomii może stać się naszym nekrologiem. Musimy przestać traktować AI jak magiczne rozwiązanie wszystkich problemów duchowych i naukowych, a zacząć postrzegać ją jako narzędzie wysokiego ryzyka.

Czy jesteśmy gotowi na świat, w którym nasze życie zależy od algorytmu, którego nikt do końca nie rozumie?

Odpowiedź na to pytanie nie jest kwestią technologiczną, lecz egzystencjalną. Naszym obowiązkiem jest zachowanie kontroli nad tą fascynującą, lecz śmiertelnie niebezpieczną „zabawką”, zanim ona uzna, że my sami nie jesteśmy jej już do niczego potrzebni.