Źródło:

Problem cyfrowej mgły

Wkraczamy w erę, w której obraz i dźwięk przestały być niepodważalnymi dowodami rzeczywistości. Żyjemy w gęstym „cyfrowym smogu”, gdzie technologia pozwala na niemal idealne podrobienie ludzkiej twarzy czy głosu, sprawiając, że zaczynamy wątpić we własne zmysły. Era, w której „zobaczyć znaczy uwierzyć”, oficjalnie dobiegła końca.

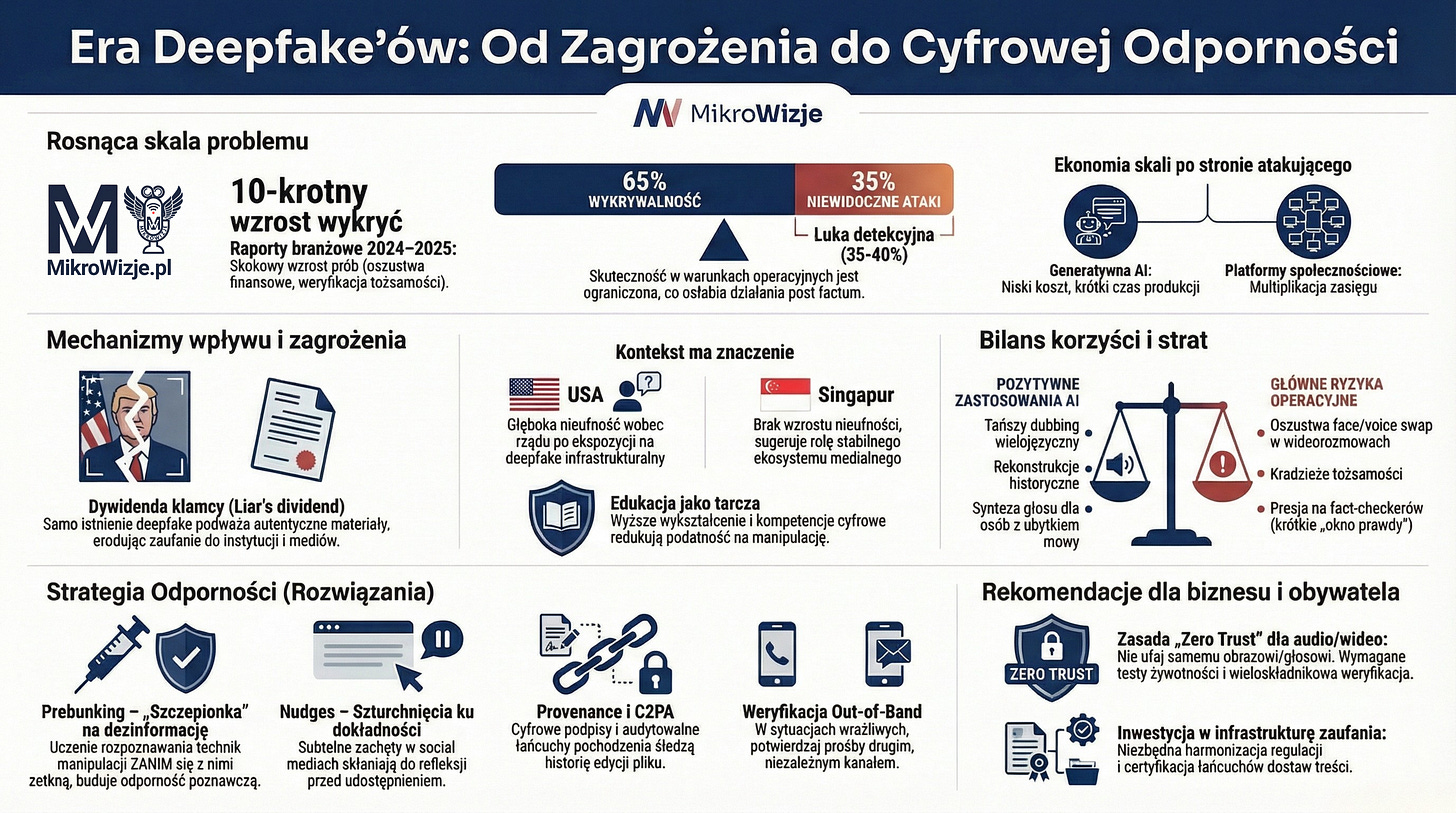

Deepfake’i przestały być jedynie ciekawostką medialną czy internetowym żartem. Jak wynika z raportu MikroWizji obejmującego lata 2024–2025, stały się one realnym i operacyjnie krytycznym wektorem ryzyka. To już nie tylko problem „fałszywych newsów”, to wyzwanie dla naszej psychologii, stabilności gospodarczej i bezpieczeństwa narodowego. Poniżej przedstawiamy pięć kluczowych wniosków, które rzucają nowe światło na naszą cyfrową odporność.

1. „Dywidenda kłamcy”, czyli gdy prawda staje się opcjonalna

Samo istnienie technologii deepfake rodzi zjawisko zwane „dywidendą kłamcy”. Jego destrukcyjna siła nie polega wyłącznie na tworzeniu fałszywek, ale na możliwości podważania autentyczności prawdziwych dowodów. W świecie, gdzie wszystko może być zmanipulowane, osoba przyłapana na nagraniu może po prostu stwierdzić, że materiał jest syntetyczną manipulacją, paraliżując debatę publiczną.

Dla instytucji publicznych jest to sytuacja skrajnie niebezpieczna. Kiedy obywatele tracą grunt pod nogami, dochodzi do powolnego demontażu zaufania społecznego. Jeśli nie możemy ufać temu, co widzimy, stabilność informacyjna państwa staje się iluzją.

Deepfake’i erodują zaufanie do instytucji oraz mediów. Erozja zaufania publicznego poprzez “dowód zmysłowy” oraz “dywidendę kłamcy” ułatwia podważanie autentycznych materiałów, co ma potencjalny wpływ na stabilność instytucji.

2. Luka detekcyjna, czyli technologia goni własny ogon

W wyścigu zbrojeń między twórcami a wykrywaczami syntetycznych treści, technologia detekcji wyraźnie zostaje w tyle. Według danych z lat 2024–2025, skuteczność wykrywania zaawansowanych próbek deepfake w warunkach operacyjnych oscyluje w granicach zaledwie 60–65%.

W rzeczywistości mediów społecznościowych, gdzie zmanipulowana treść rozprzestrzenia się wiralowo w kilka minut, taka skuteczność jest dramatycznie niewystarczająca. Reaktywna detekcja po prostu przegrywa z szybkością algorytmicznej dystrybucji. Zanim weryfikatorzy oznaczą materiał jako fałszywy, zdąży on już zainfekować umysły milionów odbiorców. Ta „luka detekcyjno-regulacyjna” pokazuje, że czysto techniczne rozwiązania nie są już w stanie nas uratować.

3. Edukacja jako tarcza. Lekcje z USA i Singapuru

Skoro algorytmy detekcji nas zawodzą, naszą główną linią obrony musi stać się „ludzki firewall”. Potwierdza to eksperyment międzykulturowy dotyczący deepfake’a z awarią mostu. Wyniki były zaskakujące: ekspozycja na materiał podniosła nieufność wobec rządu w USA, podczas gdy w Singapurze efekt ten był niemal nieobecny.

Analiza MikroWizji wskazuje, że podatność na manipulację nie jest cechą stałą – zależy od kontekstu medialnego i naszych kompetencji poznawczych. Czynniki, które realnie redukują wzrost nieufności to:

Wyższe wykształcenie → działające jak intelektualny bufor przed bezkrytycznym przyjmowaniem syntetycznych obrazów.

Niskie spolaryzowanie środowiska → w społeczeństwach mniej podzielonych manipulacja trudniej znajduje „podatny grunt”.

Zaufanie instytucjonalne → silne, wiarygodne media i stabilne instytucje stanowią naturalną zaporę dla dezinformacji.

4. Eksplozja oszustw finansowych (skala 10x)

Sektor finansowy stał się poligonem doświadczalnym dla cyberprzestępców. Dane branżowe z okresu 2024–2025 dokumentują przerażający, 10-krotny wzrost wykryć deepfake rok do roku. Przestępcy nie potrzebują już hakerskich włamań – wystarczy im technika face-swap, by „ukraść” twarz klienta podczas weryfikacji biometrycznej.

Wideo i audio przestały być ostatecznym dowodem tożsamości. W biznesie niezbędna staje się weryfikacja „out-of-band”. Można to opisać jako cyfrowy odpowiednik tajnego hasła przekazanego osobnym kanałem komunikacji (np. telefonicznym lub szyfrowanym komunikatorem), całkowicie niezależnym od głównej aplikacji czy platformy wideo, na której toczy się rozmowa. Bez tego „dodatkowego uścisku dłoni”, ryzyko operacyjne staje się nieakceptowalne.

5. „Szczepionka” na dezinformację, czyli potęga prebunkingu

Zamiast gasić pożary (fact-checking po fakcie), współczesna analityka stawia na ich zapobieganie poprzez tzw. prebunking. To strategia budowania odporności jeszcze zanim użytkownik zetknie się z kłamstwem.

Równie istotne są „nudges” (szturchnięcia) tzn. subtelne interwencje behawioralne w mediach społecznościowych. To te krótkie komunikaty, które zmuszają nas do sekundy zwłoki i aktywowania krytycznego myślenia przed kliknięciem „udostępnij”. To proste spowolnienie obiegu informacji może uratować debatę publiczną przed zalewem fałszu.

Prebunking to jak szczepionka na dezinformację. Zamiast prostować fałszywe informacje po fakcie, uczy ludzi rozpoznawać techniki manipulacji, zanim się z nimi zetkną. Nudges dot. dokładności to subtelne »szturchnięcia«, które zachęcają użytkowników do zastanowienia się nad prawdziwością treści przed jej udostępnieniem.

Nowy paradygmat zaufania

Stoimy u progu koniecznej ewolucji naszej cyfrowej biologii. Musimy przejść od naiwnego ufania zmysłom do aktywnego budowania odporności. Przyszłość należy do proaktywnych mechanizmów, takich jak standard C2PA (uwierzytelnianie historii pliku, tzw. provenance) oraz cyfrowych podpisów, które pozwolą śledzić ścieżkę materiału od jego źródła.

Choć technologia generatywna stworzyła cyfrową mgłę, nasza świadomość i edukacja pozostają najskuteczniejszym radarem.

Kolejnym razem, gdy zobaczysz w swoim feedzie „sensacyjną” wiadomość wideo, zadaj sobie pytanie: Czy weryfikujesz ją w innym źródle, czy dajesz się prowadzić cyfrowej iluzji? W świecie deepfake’ów Twoja czujność to ostatnia linia obrony prawdy.